מבוא לסטטיסטיקה והסתברות א`

מבוא לסטטיסטיקה והסתברות א'

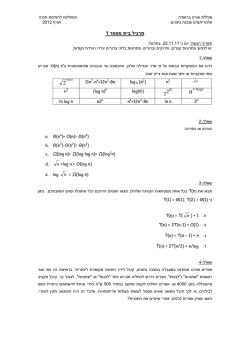

בס"ד ,ז' כסלו תשע"א :שיעור 11

התפלגות מותנית.pX|y (x, y) = pX,Y (x, y) /pY (y) :

P

תוחלת מותנית.E [X | Y = y] = x xpX|Y (x, y) ,E [X | A] = x xpX|A (x) :

נוסחת התוחלת השלמה:

Pn

נתונים מאורעות זרים A1 , . . . , Anהמחלקים את .E [X] = i=1 E [X | Ai ] P (Ai ) .Ω

הוכחה:

P

P P

P

P

P

] E [X] = x xpX (x) = x x i P (Ai ) pX|Ai (x) = i P (Ai ) x xpX|Ai (x) = i P (Ai ) E [X | Ai

P

או.E [X] = ni=1 E [X | Ai ] P (Ai ) = E [E [X | Ai ]] :

באותו אופן.E [E [X | Y ]] = E [X] ,

דוגמא:

כותבים תרגיל תכנות שוב ושוב עד שמצליחים בהסתברות ,pב"ת בנסיונות קודמים .מה תוחלת מספר הנסיונות?

) X ∼ Geo (pוהתוחלת . p1נראה זאת שוב.

נסמן .A0 = {X > 1} ,A1 = {X = 1}:אזי .E [X] = E [X | A1 ] + E [X | X > 1] :ואז ,E [X | A1 ] = 1

].E [X | X > 1] = 1 + E [X

)]E [X] = P (A1 ) E [X | A1 ] + P (A2 ) E [X | A2 ] = p + (1 − p) (1 + E [X

ניתן להעביר אגפים ולקבל .E [X] = p1

באותו אופן ניתן לחשב את ] E [X 2לצורך השונות.

משתנים מקריים בלתי תלויים:

שני משתנים מקריים X, Yייקראו בלתי תלויים אם ) PX,Y (x, y) = pX (x) pY (yלכל .x, y

דוגמא :בכד 3כדורים ממוספרים 1, 2, 3מוציאים כדורים ללא החזרהX .־ המספר הראשוןY .־ המספר השני.

P

3

2

1

1

6

1

6

1

6

0

0

0

1

6

1

6

1

6

1

2

3

כבר ניתן לראות מ־) (1, 1שהוא אפס שהוא לא מכפלת ההתפלגויות .אבל דבר מעניין ־ הם תלויים ,אבל

ההתפלגות השולית שלהם שווה.

מטילים מטבע פעמיים 1 X .אם יצא עץ בראשון 1 Y .אם יצא עץ בשני .Z = X Y .האם Zתלוי ב ?Xלא.

האם Zב"ת ב־ Xו־ ?Yברור שלא ,אם כי לא הגדרנו אי תלות לשני משתנים.

ננסה הגדרה X, Y, Z :מ"מ נקראים ב"ת אם ) pX,Y,Z (x, y, z) = pX (x) pY (y) pZ (zלכל .x, y, zבעבר דרשנו

הגדרה שתכלול את כל תת־הקבוצות .מה כאן?

משפט :התנאי של אי תלות בשלשות גורר אי תלות בזוגות.

הוכחה :נתון ־ ) pX,Y,Z (x, y, z) = pX (x) pY (y) pZ (zלכל .x, y, zצ"ל ) pX,Z (x, z) = pX (x) pZ (zלכל

P

P

P

.x, zאנו יודעים כי = )pX,Z (x, z) = y pX,Y,Z (x, y, z) = y pX (x) pY (y) pZ (z) = pX (x) pZ (z) y pY (y

)pX (x) pZ (z) · 1 = pX (x) pZ (z

דוגמא :נניח X, Yמשתנים גיאומטריים עם סיכוי הצלחה ,pב"ת ,מה ההתפלגות )?P (X = x | X + Y = n

i−1

n−2

2

)=n−i

p(1−p)n−i−1

)y (n−i

.P (X = i | X + Y = n) = P (x=i,Yהביטוי לא תלוי

= pXP (i)p

)= p(1−p)P (x+y=n

)= pP (1−p

)P (x+y=n

)(x+y=n

)(x+y=n

1

.P (X = i | X + Y = n) = n−1

ב־ iולכן הוא אחיד לכל ערך ,iונקבל

1

ראינו שתוחלת של סכום משתנים מקריים היא סכום התוחלות ,גם אם הם ב"ת .אולם ישנם תופעות שתלויות באי

תלות.

למשל עבור X, Yב"ת נקבל:

P P

P P

P

P

] .E [XY ] = x y pX,Y (x, y) = x y pX (x) pY (y) = x pX (x) y py (y) = E [X] E [Y

משפט :אם X, Yב"ת אזי ) .V ar (X + Y ) = V ar (X) + V ar (Y

הוכחה:

˜

˜

)] .V ar (X + Y ) = V ar (X − E [X]h + iY − Eh[Y iנסמן ] .X = X − E [X] , Y = Y − E [Yמתקיים

˜ = E Y˜ = 0

.E Xטענה :אם X, Yב"ת ,אזי ) g (X) , h (Yב"ת.

אזי

2

2

h

i

˜˜ + Y

˜ + Y˜ − E X

˜˜ + Y

˜˜ + Y

˜ 2 + 2X

= ˜ Y˜ + Y˜ 2

V ar X

= E X

=E X

=E X

h i

h

i

h i

h i

h i h i

h i

˜ 2 + 2E X

˜ Y˜ + E Y˜ 2 = E X

˜ 2 + 2E X

= ˜ E Y˜ + E Y˜ 2

= E X

h i

h i

2

2

˜

˜

˜

˜= E X + E Y = V ar X + V ar Y

P

שונות של התפלגות בינומית .X ∼ Bin (p, n) :נגדיר Xiהצלחה בניסוי .iאזי Xi

P

P

P

).V ar (X) = V ar ( i Xi ) = i V ar (Xi ) = i p (1 − p) = np (1 − p

סיכום ־ משתנים מקריים בדידים:

למה משתנים רציפים? מאפשר להשתמש במשפחות פשוטות יותר מאשר להעלות את רמת האפשרויות למשתנה

הבדיד.

לא נחזור על מה שהגדרנו במאורעות ־ דברנו כבר על מאורעות רציפים.

´

הגדרה :מ"מ Xייקרא רציף אם קיימת פונקציה חיובית ) fX (xכך ש־ fX (x) .P (x ∈ B) = B fX (x) dxהיא

פונקצית צפיפות.

i

= .Xולכן

ˆb

= )]P (x ∈ [a, b

)fX (x) dx = P (a < x ≤ b) = P (a < x < b

a

∞´

כך ש ־ fX (x) dx = 1

∞´ −

x+δ

.P (x ∈ [x, x + δ]) = x fX (t) dt ≈ fX (x) · δ

בס"ד ,י"א כסלו תשע"א :שיעור 12־ משתנים מקריים רציפים

ˆx+δ

= )P (x ≤ X ≤ x + δ

)fX (t) dt ≈ fX (x

x

∞´

כאשר ) fX (tפונקצית צפיפות אי שלילית .ו־ fX (x) dx = 1

c 0 ≤ x ≤ 1

= ) fX (xהאם זוהי פונקצית צפיפות? כדי שהאינטגרל יהיה 1אין לי חופש בבחירת

דוגמא:

0 otherwise

:c

∞ˆ

ˆ1

ˆ1

fX (x) dx = cdx = c dx = 1 ⇒ c = 1

∞−

0

2

0

∞−

a≤x≤b

c

= ) fX (xנקבל

1

b−a

= .c

עבור

0 otherwise

איך ניתן לזהות ישר ש־) fX (xאינה פונקצית ההסתברות עצמה? זה לא חייב להיות מוגבל ב־.1

האם ראינו משתנה דיסקרטי שמוגדר על מספר אינסופי של מספרים שלמים? כן ,זה לא הופך למשתנה רציף.

משתנה רציף זה רק אם הגדרנו פונקצית צפיפות העונה על התנאים הבאים.

2

דוגמא :זמן נסיעה לעבודה של משה מתפלג אחיד בין 15ל 20דקות ביום שמש 3מהימים ובין 25־ 20דקות ביום

הצפיפות?

חורף .מהי פונקציית

c 20 < x < 25

1

.fX (x) = c2 15 < x < 20נדרש כי:

0 otherwise

ˆ25

fX (x) dx

ˆ20

fX (x) dx +

20

∞ˆ

= fX (x) dx

∞−

15

ˆ20

2

15

= dx = 5c1 ⇒ c1

1

15

= dx = 5c2 ⇒ c2

15

ˆ25

2

= c1

3

1

= c2

3

20

ˆ20

= fX (x) dx

15

ˆ25

= fX (x) dx

20

)קבועה( למקוטעין.

פונקציה כזו נקראת אחידה

√1

´ 1 dx

0<x≤1

2 x

= ) .fX (xהאם זוהי פונקצית צפיפות? צריך לבדוק את האינטגרל√ = .

דוגמא:

0 2 x

0

otherwise

√

. x |10 = 1

∞´

ננסה להגדיר.E (X) = −∞ xfX (x) dx :

´b

´ b xdx

1

b2 −a2

.E (X) = a b−a

= b−a

)xdx = 2(b−a

= a+b

כאשר Xאחיד בין aל:b

2

a

∞´

.E [g (X)] = −∞ g (x) fX (x) dx

.V ar (X) = E (X − E [X])2

λe−λx x > 0

´ ∞ −λx

∞ −λx

0 λe dx = −eזה

= ) :fX (xזוהי צפיפות כי|0 = 1 :

משתנה מקרי אקספוננציאלי:

0

x≤0

נראה כמו פואסוני ,אבל מתאים יותר לבעיות של זמן עד) ...כמו גיאומטרי בבדיד(

1 −λx ∞ 1

e

=

0

λ

λ

∞ˆ

−e−λx dx = 0 −

∞

xλe−λx dx = −xe−λx 0 −

0

∞ˆ

== ]E [X

0

3

2

2

E [X] = 2

λ

λ

∞ˆ

= 2xe−λx dx

∞

dx = −x2 e−λx 0 +

∞ˆ

−λx

2

x λe

0

2

1

1

= 2

λ

λ

= E X2

0

2

V ar (X) = E X 2 − E 2 [X] = 2 −

λ

מצטברתCumulative Distribution Function :

פונקציית התפלגות

P

)pX (k

FX (x) = P (x ≤ x) = ´ xk≤xאזי ) .P (20 ≤ X ≤ 25) = FX (25) − FX (20ומתקיים מההגדרה

f (t) dt

−∞ X

)fX (x) = dFdxX (x

תכונות:

0 ≤ FX (x) ≤ 1 .1לכל .x

.2מקרה דיסקרטי ־ רציפה למקוטעין.

.3מקרה רציף ־ רציפה.

.4מונוטונית לא יורדת.

נגדיר מ"מ ) .0 ≤ Y ≤ 1 Y = FX (xאזי:

FY (y) = P (Y ≤ y) = P (FX (x) ≤ y) = P FX−1 (FX (x)) ≤ FX−1 (y) = P X ≤ FX−1 (y) = FX FX−1 (y) = y

קבלנו FY (y) = yעבור ,0 ≤ y ≤ 1ולכן ).Y ∼ U (0, 1

מסקנה :ההתפלגות המצטברת היא תמיד אחידה.

בס"ד ,י"ד כסלו תשע"א :שיעור 13

משתנה מקרי נורמלי סטנדרטי

1 − 21 x2

e

fX (x) = 2πלכל ) .x ∈ Rתרגול :הוכח שזו הסתברות(.

תוחלת :זוהי פונקציה זוגית ולכן התוחלת חייבת להיות = 0 .0

∞

∞ˆ

1 − 1 x2

−1 − 1 x2

1 − 1 x2

x

+

= e 2 dx

xe 2

e 2 dx = 0+1 = 1

2π

2π

2π

∞−

∞i

∞−

= x 1 e− 2 x dx

−∞ 2π

∞ˆ

2

∞−

1 2

−e− 2 x

h

1

2π

1 2

∞´

= V ar [X] = E X 2 −E 2 [X] = E X 2

∞−

(x−µ)2

1

.fX (x) = √2πσעם שני פרמטרים .µ, σ 2

משתנה מקרי נורמלי e− 2σ2

2

.Y = x−µנניח כי Yנורמלי סטנדרטי .אזי

נגדיר משתנה מקרי

σ

E [X] = E [σY + µ] = σE [Y ] + µ = 0 + µ = µ

µאם כן קובע את התוחלת .ו־ .V ar (X) = V ar (σY + µ) = V ar (αY ) = σ 2 V ar (Y ) = σ 2

לא נוכיח כעת כי Yנורמלי סטנדרטי ,תרגיל טוב לבית ,ושבוע הבא נלמד להוכיח בצורה קלה יותר.

4

= ].E [X

התפלגות משותפת:

¨

= )P ((X, Y ) ∈ B

fX,Y (x, y) dxdy

x,y∈B

ˆx+δ ˆy+δ

= )P (x ≤ X ≤ x + δ, y ≤ Y ≤ y + δ

fX,Y (s, t) dtds

x

y

)P (x≤X≤x+δ,y≤Y ≤y+δ

δ2

כאשר δקטן זה שווה ל־ .f (x, y) · δ 2ולכן

התפלגות שולית:

∞´ ´

´

P (x ∈ A) = P ({x ∈ A} ∩ {Y ∈ (−∞, ∞)}) = A −∞ fX,Y (x, y) dydx = fX (x) dx

∞´

ולכן fX (x) = −∞ fX,Y (x, y) dy

דוגמא :המחט של בופון )(1777

נניח שיש לנו משטח מרוצף בפסי עץ באורך .dלוקחים מקל באורך lעל המשטח ,מה הסיכוי שהמקל )באגט(

יפגע באחד הקוים? נניח .l < dנסמן θאת הזוית בין המחט לאחד הקוים X .־ המרחק בין מרכז המקל לקו הקרוב.

אם X ≤ 2l sin θאזי יש חציה.

π

π

זוהי הצפיפות לנקודה זו.

π

ˆ2 lˆsin θ

ˆ2

ˆ2

4

2l

4

l

2l

= dxdθ

= sin θdθ

= fX,Θ (x, θ) dxdθ

= sin θdθ

πd

πd

2

πd

πd

0

נגדיר

0

x ∈ 0, d2 , θ ∈ 0, π2

0

4

πd

0

ˆ

ˆ

=

l

sin θ

2

≤X

P

X≤ 2l sin θ

= )fX,Θ (x, θ

0

התפלגות מותנית

פונקצית ) fX|A (xחיובית המקיימת P (X ∈ C | A) = C´fX|A (x) dxלכל ,Bתיקרא פונקציית צפיפות מותנית.

fX (x)dx

= A∩B

מקרה פרטי :מתנים על X ∈ Aאזי

) ,P (X ∈ B | X ∈ A) = P (x∈B∩x∈Aונקבל

)P (x∈A

)P (x∈A

) fX (x

x∈A

)fX|A (x) = P (X∈A

0

בס"ד ,י"ח כסלו תשע"א :שעור 14

´

• צריך לדעת:

´b

2

• a xe−x dxצריך לפתור די מהר.

– אינטרגרל כפולf (x, y) dx dy :

• הגדרנו התפלגות מותנה

x∈A

´ ´

)fx (x

)P (x∈A

־ כמו סכימה כפולה.

= ).fX|{x∈A} (x

0

– דוגמא :הזמן עד שנורה נשרפת Xמתפלג אקספוננציאלי עם פרמטר .λמשה מדליק את האור ,יוצא

מהחדר ,וחוזר לאחר זמן tורואה שהאור עדיין דלוק .חשב את ).fX|x≥t (x

)= λe−λ(x−t) = fX (x − t

λe−λx

e−λt

−λx

λe

= 1−F

=

)X (t

5

λe−λx

)1−P (x<t

=

)fX (x

)P (x≥t

= ).fX|x≥t (x

)(x,y

f

fX|Y (x | y) = X,Yלמה זוהי פונקצית צפיפות? כי כשעוברים ,xהמכנה הוא קבוע ,והמונה הוא צפיפות

•

)fY (y

שולית של ,yולכן שווה לאחד.

– דוגמא :משה זורק חץ על מטרה עגולה עם רדיוס .rנניח שהוא תמיד פוגע ,ובאופן אחיד .המטרה:

להגדיר התפלגויות.

1 x2 + y 2 < r 2

2

.fX,Y (x, y) = πr

∗ התפלגות משותפת:

0

∗ התפלגות שולית:

p

2 r2 − y 2

dx

=

πr2

πr2

√

2

2

ˆr −y

= )fY (y

r2 −y 2

הצפיפות של yהיא לא אחידה.

√1

x2 ≤ r 2 − y 2

1

2 −y 2

2

2

r

πr

= (x | y) = 1 √ 2 2

∗

2 r −y

πr 2

0

יש פיזור אחיד של .x

√

−

.fX|Yזוהי צפיפות אחידה מאחר ובהינתן y

´

• נגדיר .P (x ∈ A | Y = y) = A fX|Y (x | y) dxכמו שהגדרנו הסתברות של מאורע .כאן ניתן להתנות על

מאורע שהסיכוי שלו אפס ,כי יש צפיפות אם נרחיב עם .δ

• xfX|A (x) dx

∞´

∞−

= ].E [X | A

P

– משפט E [X] = nx=1 P (Ai ) E [X | Ai ] :עבור A1 , . . . , Anחלוקה של .Ω

pλe−λx

x>0

= ) fX (xעבור .0 ≤ p ≤ 1אזי

∗ דוגמא:

(1 − p) eλx x ≤ 0

) .E [X] = E [X | X > 0] P (X > 0) + E [X | x ≤ 0] P (X ≤ 0נשים לב כי

´ ∞ −λx

2p−1

.E [X] = λp − 1−pלחישוב השונות ,נשתמש

=

ולכן

,P

(X

>

)0

=

p

λe

=p

λ

λ

0

2

2

2

ב־] E [X ] = P (X ≥ 0) E [X | X ≥ 0] + P (X < 0) E [X | X < 0ואת זה חישבנו בעבר.

• הגדרה :שני משתנים הם בלתי תלויים עם ) fX,Y (x, y) = fX (x) fY (yלכל .x, y

).fX|Y (x | y) = fX (x

– אם X, Yב"ת אזי

ˆ

ˆ ˆ

= fX,Y (x, y) dy dx = fX (x) fY (y) dy dx

B

ˆ

= )P (x ∈ A ∩ y ∈ B

A B

ˆ

ˆ

)fY (y) dy = P (X ∈ A) P (x ∈ A

=

fX (x) dx

B

במיוחד עבור B = Y < b ,A = X < aזוהי התפלגות מצטברת.

6

אפשר לדבר על

A

A

– משפט E [g (x) h (y)] = E [g (X)] E [h (Y )] 6= g (E [X]) h (E [Y ]) :ונקבל שוויון רק בליניארי.

– דוגמא :בהתקפת קניות מבקרים במספר מקרי Nשל חנויות נתון ] E [Nובחנות ה־ iמבזבזים סכום מקרי

P

Xiבתוחלת ] .E [Xנגדיר Xi .T = ni=1 Xiב"ת זב"ז וב־ .Nמה התוחלת של ?T

P

∗ ] .E [T | N = n] = ni=1 E [X] = nE [Xולכן

] npN (n) = E [X] E [N

∞

X

]pN (n) nE [X] = E [X

n=1

∞

X

= ]pN (n) E [T | N = n

n=1

∞

X

= ] E [T

n=1

בינתיים לא השתמשנו באי התלות ,אבל בשונות נצטרך להשתמש בה )לא נבצע בשיעור(.

• נוסחת בייס:

)fY |X (y|x)fX (x

)fY (y

= ).fX|Y (x | y

)P (y ≤ Y ≤ y + δ | A) P (A

=

δ→0

δ→0

)P (y ≤ Y ≤ y + δ

)fY |A (y) · δ · P (A

)fY |A (y) P (A

=

= lim

δ→0

fY (y) δ

)fY (y

P (A | Y = y) = lim P (A | y ≤ Y ≤ y + δ) = lim

כשמתנים על מאורע מסוים מרחיבים לסביבה של ,δואח"כ זה נעלם.

– לנסות בביתfY |A (y) :

בס"ד ,כ"א כסלו תשע"א :שיעור 15

P

• תיקון טעות :בדוגמת החנויות הגדרנו T = n Xnואז המשכנו

P

P

= ] E [T | N = n] = E [ Xi | N = n־ במעבר האחרון השתמשנו באי

ל־ ]E [Xi | N = n] = nE [X

תלות.

• דברנו על חוק בייס ,וכעת נדגים :אות בינארי ,Sכאשר .pS (1) = pהאות עובר מ־ Sלמשדיר .נוסף

1 2

לו שם רעש Nשמתפלג באופן נורמלי סטנדרטי ,וב"ת ב־ .PS|Y .Sנוסחת .fN (n) = √12π e− 2 nאזי

(y−1)2

2

y2

2

p· √1 e−

+(1−p)· √1 e−

2π

2π

(y−1)2

−

2

e

=

p· √1

)fY |S=1 (y)P (S=1

)fY |S=1 (y)P (S=1)+fY |S=0 (y)P (S=0

=

)fY |S=1 (y)P (S=1

)fY (y

= ).P (S = 1 | Y = y

2π

• טרנספורמציות

נניח ) Y = g (Xלמשל:

x−µ

σ

= .Yבאופן כללי :נתון ) ,fX (xרוצים את ).fY (y

´

.1נחשב את .FY (y) = P (Y ≤ y) = P (g (X) ≤ y) = x:g(x)≤y fX (x) dx

הסתברות ,החוקים שלמדנו על פונקציות כאלו תקפות.

.2נחשב

)dFY (y

dy

מאחר וזו פונקצית

= ).fY (y

√

– דוגמאx ,X ∼ [0, 1] :

= ,Yנקבל עבור ,0 ≤ y ≤ 1

x < y = P x < y2 = y2

√

FY (y) = P (g (X) ≤ y) = P

)כבר ראינו כי .(P (X < a) = aולכן נקבל fY (y) = 2yבתחום .0 < y < 1נבדוק כי זו צפיפות

´1

1

חוקית. 0 2ydy = [y 2 ]0 = 1 :

7

– דוגמא .Y = g (X) = X 2 :נתון ) ,fX (xוגם ) FX (xאזי

√

√

√

√

)FY (y) = P X 2 < y = P (− y < X < y) = FX ( y) − FX (− y

√

√

) fX ( y

) fX ( − y

√ d−√y

√ d√y

.fY (y) = fXאם הטווח של Xמוגבל

ומכאן ש־ y dy − fX − y dy = 2√y + 2√y

צריך לקחת את זה בחשבון .זה לא תקף עבור ,y = 0אבל כל עוד מדובר במספר סופי של נקודות אפשר

להוציא אותם .השורש מגביל אותנו ל־ ,y > 0אבל זה נתון מההגדרה של .Y = X 2

– נתון ) Y = g (Xמונוטוני ממש .נניח עבור מונוטונית יורדת ,g 0 (X) < 0ועבור מונוטונית עולה

g 0 (X) > 0לכל .x

מונוטוני יורד FY (y) = P (g (X) < y) = P (X > g −1 (y)) = 1 − FX (g −1 (y)) :ולכן

– עבור −1

)dg −1 (y

−1

−1

) ,fY (y) = −fX (g (y)) dy (y) = fX (g (y)) dg dy(y) (yוהנוסחא האחרונה עם הערך המוחלט

נכונה גם למונוטונית עולה.

Y −µ

σ

1 2

√1 e− 2 x

2π

– נחזור לדוגמא= g −1 (y) :

1 y−µ 2

fY (y) = √12π e− 2 ( σ ) · σ1וזוהי הנוסחא שרשמנו למשתנה נורמלי לא סטנדרטי E [Y ] = µ .ו־

.V ar (Y ) = σ 2

= ,Xאזי ,g (X) = σX + µנזכור כי

= ) fX (xאזי

• קשר בין Xל־ .Y

מהתפלגות משותפת ניתן להגיע להתפלגות שולית ,או מותנה וכד' ,אבל הרבה פעמים זה לא נוח .ננסה לקשר

באופן הבא:

– דוגמא :נניח כי ציר ה־ xמייצג את ] ,X − E [Xוציר ה־ yיהיה ] .Y − E [Yאם יש לי תצפית שתוצאתה

ברבע הראשון )מעל הממוצע של שניהם( ,יש לי נטיה לומר שהם תלויים זה בזה .למשל :בקוביה X־

המספר שיוצאY ,־ המספר שיוצא .1+הישר שנקבל יהיה .y = xבאופן דומה אם התוצאה ברבע השלישי.

אם יש תוצאה ברבע השני או הרביעי נקבל יחס הפוך בין Xל־ .Y

– באופן כללי נגדיר מדד של ])] cov (X, Y ) = E [(X − E [X]) (Y − E [Yנקרא covarianceאו שונות

משותפת .זוהי תוחלת על שני משתנים מקריים ,כלומר סכום כפול או אינטגרל כפול ,אבל נשאיר את זה

באופן כללי.

– אם cov (X, Y ) = 0אז Xו־ Yנקראים בלתי מתואמים.

– ] cov (X, Y ) = E [XY ] − E [E [X] Y ] − E [E [Y ] X] + E [E [X] E [Y ]] = E [XY ] − E [X] E [Y

– אם X, Yב"ת אז ] E [XY ] = E [X] E [Yולכן cov (X, Y ) = 0והם בלתי מתואמים.

– הכיוון ההפוך לא נכון :אם יש לנו 4מאורעות בהסתברות רבע של ) ,(1, 0) , (−1, 0) , (0, 1) , (0, −1הם

לא ב"ת כי ,P (Y = 1 | X = 1) = 0אבל ההסתברות של ) P (Y = 1היא . 14האם בלתי מתואמים?

.E [X] = E [Y ] = 0מה אפשר לומר על XYלכל ערך אפשרי? אפס ,ולכן ,E [XY ] = 0בסה"כ

.cov (X, Y ) = E [XY ] − E [X] E [Y ] = 0

• מקדם מיתאם:

– ≤1

) cov(X,Y

) V ar(X)V ar(Y

√ = ) −1 ≤ ρ (X, Y

8

בס"ד ,כ"ה כסלו תשע"א :שיעור 16

• דוגמא :בכד יש 3כדורים ממוספרים .1,2,3מוציאים 2כדורים ללא החזרהX .־ מספר הכדור הראשון.

Y־מספר הכדור השני ,X ∼ U (1, 3) .ולכן .E [X] = 2נחשב את

1

1 1 1 1

= · · +

2 3 2 3

3

pY (y) = pY |X=1 (y) pX (1) + pY |X=2 (y) pX (2) = pY |X=3 (y) pX (3) = 0 +

ולכן X, Yשווי התפלגות .ולכן גם .E [Y ] = 2

2

3

= ) .V ar (X) = V ar (Y

נחשב את

= cov (X, Y ) = E [(X − E [X]) (Y − E [Y ])] = E [XY ] − E [X] E [Y ] = E [XY ] − 2 · 2

XX

XX

11

1

1

=

= xy · pX,Y (x, y) − 4

−4=−

= · xy

6

3

3

x

y

x y6=x

1

−

מקדם המיתאם= √ 23 2 = − 12 :

·

3 3

) cov(X,Y

√ = ) .ρ (X, Y

) V ar(X)V ar(Y

• מטרה :נניח שרוצים למדל את הקשר בין Xל־ Yבעזרת קו .Y = aX + bמטרה פורמלית :נסתכל על

) min V ar (Y − aX − bשזוהי הטעות של המודל .זה שווה ל־ ) , min V ar (Y − aXואח"כ נכניס את b

ˆ.

המתאים .אנחנו מחפשים )a = arg min V ar (Y − aX

= V ar (Y − aX) = E ((Y − E [Y ]) − a (X − E [X]))2

= = E (Y − E [Y ])2 − 2aE [(X − E [X]) (Y − E [Y ])] + a2 E (X − E [X])2

הפונקציה תגיע למינימום בנקודה

) std(Y

)std(X

)= C − a (2cov (X, Y )) + a2 V ar (x

q

) V ar(Y

)

=

ρ

(X,

Y

)

·

· ) = ρ (X, Y

ˆ.

a = cov(X,Y

)V ar(X

)V ar(X

• דוגמא n :הטלות עם סיכוי pלראשX .־ מספר הראשיםY .־ מספר הזנבות .אזי ,Y = n − Xואנו מצפים

שהשונות המשותפת תהיה שלילית ,E [X] + E [Y ] = n ,וגם ,X + Y = nולכן

) .(X − E [X]) (Y − E [Y ]) = − (X − E [X])2 = −V ar (Xנזכור כי

)V ar (Y ) = V ar (n − X) = V ar (−X) = (−1)2 V ar (X) = V ar (X

ולכן מקדם המיתאם יהיה = −1

)−V ar(X

) V ar(X)V ar(Y

√ = ) .ρ (X, Yלכן בפונקציה ליניארית אם המקדם של X

בפונקציה של Yמקדם המיתאם הוא 1־ ,ואם הוא חיובי מקדם המיתאם הוא ) .1תרגיל עבור מקדם שונה מ.(1

• = )] cov (aX + b, cY + d) = E [(aX + b − E [aX + b]) (cY + d − E [cY + d])] = a (X − E [X]) c (Y − E [Y

) .ac · cov (X, Y

– נשים לב כי ) cov (X, X) = E (X − E [X])2 = V ar (Xולכן .ρ (X, X) = √V ar(X) 2 = 1

)V ar(X

– התופעה גורמת לכך שאם ננפח את המשתנים ננפח גם את השונות המשותפת ,אבל מקדם המתאם:

)

ac

.ρ (aX + b, cY + d) = q ac·cov(X,Yכלומר הוא שומר

|= |ac

)ρ (X, Y ) = ρ (X, Y ) · sign (ac

√

) c2 V ar(Y

על הערך עד כדי הפיכה לשלילי.

9

)a2 V ar(X

•

= V ar (X + Y ) = E (X + Y − E [X + Y ])2 = E ((X − E [X]) + (Y − E [Y ]))2

= ])] = E (X − E [X])2 + E (Y − E [Y ])2 + 2E [(X − E [X]) (Y − E [Y

) = V ar (X) + V ar (Y ) + 2cov(X, Y

המשמעות היא שאם השונות המשותפת היא חיובית ,נקבל בחיבור ניפוח של השונות ,ואם היא שלילית היא

תצמצם אותה .במקרה שהם בלתי מתואמים ,סכום השונויות שווה לשונות הסכום )נזכור כי ב"ת הם גם בלתי

מתואמים(.

P

P

• ) ,V ar (X1 + . . . + Xn ) = ni=1 V ar (Xi ) + i6=j cov (Xi , Xjההוכחה עוברת

דרך ) cov (X + Y, Z) = cov (X, Z) + cov (Y, Zומשם ניתן להמשיך באינדוקציה.

• דברנו על ] ,E [X | Y = yנדבר באופן כללי על ] E [X | Y־ זה משתנה מקרי שהוא פונקציה של .Y

– דוגמא n :הטלות ,כך שההסתברות לראש היא ).E [X | Y = y] = yn .X ∼ Bin (y, n) .Y ∼ (0, 1

לכן .E [X | Y ] = Y · n

´

∞ E [X | Y = y] f (y) dy

Y

∞−

E [E [X | Y ]] = Pמנוסחת

– נוכל לדבר על התוחלת= E [X] :

)E [X | Y = y] p (y

Y

התוחלת השלמה .נקרא .Law of Iterated Expectation

– נחזור לדוגמא :נחשב את

n

2

y

= ] .E [X] = E [E [X | Y ]] = E [nY ] = nE [Y

–

= V ar (X) = E X 2 − E [X]2 = E E X 2 | Y − E [E [X | Y ]]2

= = E V ar (X | Y ) + E [X | Y ]2 − E [E [X | Y ]]2

)] = E [V ar (X | Y )] + E E [X | Y ]2 − E [E [X | Y ]]2 = E [V ar (X | Y )] + V ar (E [X | Y

כי ) E [X 2 ] = V ar (X) + E [X]2פעמיים(

– נחזור לדוגמא ,V ar (X | Y = y) = ny (1 − y) :ולכן .V ar (X | Y ) = Y (1 − Y ) nהתוחלת תהיה

= E (V ar (X | Y )) = E [nY (1 − Y )] = nE Y − Y 2 = n E [Y ] − E Y 2

1

1

1

n

2

= n E [Y ] − V ar (Y ) − E [Y ] = n

−

−

=

2 12 4

6

נחשב את ) .V ar (E [X | Y ]) = V ar (nY ) = n2 V ar (Y

בס"ד ,ב' טבת תשע"א :שיעור 17־ פונקציות יוצרות מומנטים

• נניח )( ∼ .Xאנו יודעים לחשב תוחלת ,ושונות של ) ,g (Xולכן ניתן לחשב את .E e−2Xנדבר באופן

כללי על .E esXאחרי שקבענו את התפלגות ,Xיש לנו פונקציה של ,sונסמן אותה .mX (s) = E esX

דוגמאות:

,X ∼ Ber (p) .1אזי .mX (s) = 1 − p + pes

10

אזי,X ∼ P ois (λ) ()א

mX (s) =

∞

X

k=0

k

sk −λ λ

e e

k!

−λ

=e

∞

X

(λes )k

k=0

k!

−λ λes

=e

e

∞

X

e

s k

−λes (λe )

k=0

k!

s

= e−λ eλe = e−λ(1−e

s)

.

s

P∞

pe

(es )k p (1 − p)k−1 = 1−(1−p)e

s אזי,X ∼ Geo (p) ()ב

´ ∞ sx −λx

´

∞

λ

λ

.mX (s) = 0 e λe dx = λ−s

(λ − s) e−(λ−s)x dx = λ−s

אזי,X ∼ exp (λ) ()ג

0

.mX (s) =

k=1

אזי,Z ∼ N (0, 1) ()ד

ˆ∞

mZ (s) =

−∞

s2

x2

1

esx √ e− 2 dx = e 2

2π

ˆ∞

−∞

s2

s2

x2

1

√ e− 2 +sx− 2 dx = e 2

2π

ˆ∞

−∞

(x−s)2

s2

1

√ e− 2 dx = e 2

2π

.mY (s) = esb mX (as) אזי,Y = aX + b ו־,mX (s) ופונקציה,X נניח יש מ"מ:• טענה

.mY (s) = E esY = E es(aX+b) = E easX esb = esb mX (as) :הוכחה

.mX (s) = esµ e

σ 2 s2

2

ולכן בעזרת הטענה נקבל.X = σX + µ אזי,X ∼ N (µ, σ 2 ) ()ה

.mX (0) = E e0X = E [1] = 1 •

•

∂

∂

mX (s) =

∂s

∂s

ˆ∞

ˆ∞

sx

e fX (x) dx =

−∞

∂ sx

e fX (x) dx =

∂s

ˆ∞

xesx fX (x) dx

−∞

−∞

∂

, באופן דומה. ∂s

mX (0) = E [X] ולכן

∂k

∂k

m

(s)

=

X

∂sk

∂sk

ˆ∞

ˆ∞

esx fX (x) dx =

−∞

xk esx fX (x) dx

−∞

k

∂k

ולכן

. ∂s

k mX (s) |s=0 = E X

−3 ∂

∂

λ

ולכן, ∂s

, ∂s mX (s) = λ (λ − s)−2 ולכן,mX (s) = λ−s

:4 • נחזור לדוגמא

2 mX (s) = 2λ (λ − s)

.E [X] = m0X (0) = λ (λ)−2 = λ1

k sk

P

P∞

2

(k)

sk

mX (s) = ∞

m

(0)

=

E

X k! = 1 + E [X] s + E [X 2 ] s2! + . . . :• טור טיילור

X

k=0

k=0

k!

2

.(• )בשיעור השני לא הייתי

18 שיעור: ה' טבת תשע"א,בס"ד

.MX (s) = E e−sX , מ"מX אם:• פונקציות יוצרות מומנטים

כמו כן־ עבור פונקצית. היא אינסופיתmX (λ + 5) ,x ∼ exp (λ) למשל עבור. לא תמיד סופי:• תכונות

1

, π(1+x

2 ) התפלגות

: אזי,a < 0 < b כך שגם,a < s < b עבורmX (s) < ∞ נניח כי

11

)(n

.mX (0) = E [X n ] .1

mX (s) = mY (s) .2עבור a < s < bאז ) .X ∼ Yמשפט היחידות(

{Xn } .3מ"מ ,ו־) limn→∞ mX (s) = m (sבתחום ,a < s < bוגם .lims→0 m (s) = 1אזי קיימת פונקצית

התפלגות מצטברת כך ש־) limn→∞ FXn (x) = F (xלכל xשהיא נקודת רציפות של .Fמעבר לזה ,אם

X ∼ Fאזי ).m (s) = mX (s

P

] E [X k

mX .4גזירה אינסוף פעמים על ) ,(a, bומתקיים לכל a < s < bכי ) .mX (s) = nk=0 k! sk + o (sn

.maX+b (s) = esb mX (as) .5

.6אם X, Yב"ת ,אז ).mX+Y (s) = mX (s) mY (s

• משפט הגבול המרכזי:

דוגמא :נניח כי X1 , X2 , . . .מ"מ ב"ת ש"ה) E [X 2 ] = 1 .סופי( .E [X] = 0 .נניח כי

∞ < ) mXi (s) = m (sעבור a < s < bכך ש־.a < 0 < b

)mXi (s) = mn (s

n

Y

= )(s

Xi

Pn

i=1

m

i=1

s

√

n

n

=m

s

√

n

Xi

(s) = m

Pn

i=1

Pn

Xi

i=1

√

n

m

Pn E [ X k ] k

2

) .m (s) = 1 + E [X] s+ E [X 2 ] s2 + o (s2

,nונקבל:

=

2

ניקח

.m

)(s

=

נזכור כי ) s + o (sn

k=0

!k

n

n

s2

2

2

2

2

.mn (s) = 1 + 0 + 12 sn + o snקבלנו כי

= 1 + n1 s2 + no sn

ובמקרה שלנו→n→∞ e 2 ,

P

s2

s2

n

1

Pn

√

,limוכי 2 = 1

2

X

<

x

→

Φ

)(x

כי

נובע

מכאן

.lim

e

Pלכל

m

)(s

=

e

X

i

∞→n

s→0

∞→n

i

i=1

i=1

n

√

n

.x

• באופן כללי אם X1 , X2 , . . .מ"מ ב"ת ש"ה עם ) E [esx ] = m (sסופית בקטע ) ,(a, bכאשר ) .0 ∈ (a, bאזי

עבור ] ,σ 2 = V ar (Xi ) ,µ = E [Xiהסדרה Xnσ−µהיא סדרת מ"מ ב"ת ש"ה עם תוחלת 0ושונות .1ולכן

Pn

P

√ 1 Pn X −m √ Xn −µ

X −nm

. √1n ni=1 Xiσ−µ = √1n i=0 σ i

== n n i=0σ i

)= n σ →n→∞ Φ (x

• משפט הגבול המרכזי :אם X1 , X2 , . . .מ"מ ב"ת ש"ה בעלי ] E [Xi2סופית ,נסמן ,V ar (Xi ) = σ 2 ,E [Xi ] =µ

´x

P

√ Xn −µ

y2

.P

אזי עבור n σ < x →n→∞ Φ (x) = √12n −∞ e− 2 dy ,Xn = n1 ni=0 Xi

– מקרה פרטי :נניח ) .X ∼ Bin (n, pניקח ) .X1 , . . . , Xn ∼ Ber (pאזי ,X ∼ X1 + . . . + Xnלכן

X

) .σ 2 = V ar (Xi ) = p (1 − pולכן לפי המשפט

,µ = E [Xi ] = p. n ∼ Xn

√

√ Xn −p

.limn→∞ Pלכן n √Xn −pמתפלג בקרוב ) ,N (0, 1או אם נכפיל מנה

√n

)≤ x = Φ (x

)p(1−p

ומכנה ,nאזי )∼ N (0, 1

)p(1−p

√X−npכאשר nגדול.

)np(1−p

מתי הקירוב "טוב"? מקובל להשתמש בקירוב זה כאשר np ≥ 5וגם .n (1 − p) ≤ 5

נניח כי אנו רוצים לחשב את

!

!

k + 12 − np

k − 12 − np

p

−Φ p

)np (1 − p

)np (1 − p

n k

1

1

n−k

)p (1 − p

= P (X = k) = P k − < X < k +

≈Φ

k

2

2

לקירוב קוראים קירוב .Laplace De Moivre

12

• אי שיוויון מרקוב וצ'ובישב

מ"מ אי שלילי ) .(P (X ≥ 0) = 1רוצים למצוא חסם להסתברות ) P (X ≥ aעבור .a > 0נגדיר

נניח כי X

0 x < a

= .Yaאזי Ya ≤ X :לכן גם ] .E [Ya ] ≤ E [Xאבל ].E [Ya ] = aP (X ≥ a) ≤ E [X

a x ≥ a

]E[X

a

≤ ).P (X ≥ a

אי שוויון מרקוב X :מ"מ אי שלילי אז לכל ,a > 0

] E [(X−E[X])2

≤ .P (|X − E [X]| ≥ a) = P (X − E [X])2 ≥ a2

)= V ar(X

מה ההסתברות

a2

a2

אי שוויון צ'ובישב X :מ"מ כלשהו עם תוחלת ∞ < | ,E |Xאז

דוגמא.X ∼ exp (λ) :

1

λ

=

]E[X

1

)V ar(X

a2

≤ ).P (|X − E [X]| ≥ a

≤ P (X > 1) = e−λ

• החוק החלש של המספרים הגדולים

נניח כי X1 , X2 , . . .מ"מ ב"ת ש"ה ,E [X12 ] < ∞ .ונסמן ] .σ 2 = V ar (X1 ) ,µ = E [X1אזי

2

limn→∞ P Xn − µ ≥ = 0לפי אי שוויון צ'בישב ) ,(V ar Xn = σn

σ2

.P Xn − µ ≥ ε ≤ nε

ולכן 2 →n→∞ 0

בס"ד ,ט' טבת תשע"א :שיעור 19

• כאשר יש לנו סדרה של מ"מ ב"ת עם תוחלת µושונות ,σ 2ראינו את החוק החלש של המספרים הגדולים ,וחוק

הגבול המרכזי.

] P (X ≥ a) ≤ E[Xמשמעות :אם התוחלת קטנה ,ההסתברות לערכים גבוהים היא

• תזכורת :אי שוויון מרקוב:

a

σ2

נמוכה .אי שוויון צ'בישב ,P (|X − µ| ≥ ε) ≤ ε2 :כלומר ,אם השונות קטנה ,הסיכוי לסטות מהממוצע הוא

קטן .צורה נוספת .P (|X − µ| ≥ kσ) ≤ k12 :אם סטיית התקן היא מדד לפיזור וניקח אותו כיחידת מידה,

יש כאן הנחה על כמה מהציונים רחוקים כך יחידות מהממוצע.

P

• החוק החלש :נסמן .limn→∞ P Xn − µ ≥ = 0 .Mn = Xn¯ = Snn ,Sn = ni=1 Xiמשמעות ־ אם נעשה

הרבה ניסויים ,הממוצע שואף לתוחלת.

מסויימת .מראיינים nאנשים ב"ת נדגמים בצורה אחידה .לכל

• ֹדוגמא :נניח ש־ pמהבוחרים תומכים במפלגה

1 men(i) support

= =Sn ,Xiכמות האנשים מתוך nשתמכו =Xn .החלק

אחד סיכוי pלתמיכה .אם

0 o.w.

)p(1−p

σ2

.P Xn − p ≥ 0.1 ≤ 0.1במקרה

מתוך nשתמכו .נניח ,n = 100נחשב את )2 = 100∗0.12 = p (1 − p

הגרוע ,p = 1 :ולכן .P Xn − p ≥ 0.1 ≤ 1אם יש מידע משוער על ,pניתן לשפר את החסם ,או לשפר

2

4

את ,nאו להשתמש באי שוויון יותר טוב.

– דיוק של 10.0בהסתברות .95%

≤ 0.05 ⇒ 1 ≤ 4n·0.000005

1

4n·0.012

≤ .P Xn − p ≥ 0.01ולכן ניתן לחלץ ולהגיע ל־.n ≥ 50, 000

• התכנסות בהסתברות:

נניח Y1 , . . . , Ynסדרה של מ"מ ב"ת .נתון a ∈ Rכך שלכל limn→∞ P (|Yn − a| ≥ ε) = 0 ,ε > 0אז Yn

מתכנס בהסתברות ל־.a

13

דוגמא :נתונה סדרה של מ"מ ) .{Xn } ∼ U (0, 1נגדיר } .Yn = min {X1 , . . . , Xnנראה כי Ynמתכנס

T

Q

בהסתברות ל־ .P (|Yn − 0| ≥ ε) = P ( ni=1 Xi ≥ ε) = ni=1 pXi (ε) = (1 − ε)n →n→∞ 0 :0תרגילnYn :

שואף להתפלגות אקספוננציאלי.

• משפט הגבול המרכזי:

נורמלית סטנדרטית.

√ Sn

−nµ

σ n

= ,Znאזי ) limn→∞ P (Zn ≤ z) = Φ (zכאשר ) Φ (zהוא התפלגות מצטברת

ראינו שהסכום שואף לתוחלת ושונות אינסופית ,והממוצע שואף לתוחלת ממוצעת ושונות .0

תזכורת ־ משתנה נורמלי סטנדרטי ־

1

ˆy

)e− t2 dt = P (Y > −y) = 1 − Φ (−y

∞−

1

√ = )Φ (y) = P (Y ≤ y) = P (Y < y

2π

הטבלה טובה רק עבור yחיובי ,בנוסחא זו נטפל ב yשלילי.

דוגמא :הודעה בינארית משודרת כסיגנל +1או .−1המשדר מוסיף רעש נורמלי עם ממוצע µ = 0ושונות

) σ 2הרעש תלוי בהרבה גורמים ־ ולכן הוא כזה לפי משפט הגבול המרכזי( .במקלט מפענחים " "1אם הסיגנל

חיובי ,ו־” ” − 1אחרת.

נסמן ב־ Nאת הרעש .טעות א' .−1 + N > 0 :טעות ב' .1 + N ≤ 0 :הסיכוי לטעות א':

.P (N ≥ 1) = 1 − P (N ≤ 1) = 1 − P Nσ ≤ σ1 = 1 − Φ σ1לדוגמא ,אם ,σ = 1אז הסיכוי לטעות א'

היא .1 − Φ (1) = 1 − 0.8413 = 0.1587

נחזור לדוגמת הבחירות P Xn − p ≥ ε ≈ 2P Xn − p ≥ ε :מסימטריה של משתנה נורמלי.

1

) .E [Xn ] = p, V ar (Xn ) = p(1−pל־ Xn − pיש תוחלת 0ושונות כמו ,Xnנחשב את

≤ 4n

n

√

) ,1 − P Xn − p ≤ ε = 1 − Φ (2 nεכמו שעשינו עם הסיגנל .כעת מ־ εניתן לחלץ את ה־ nהדרוש .במקרה

,n = 100, ε = 0.1נקבל .0.046

בס"ד ,י"ב טבת תשע"א :שיעור 20

• יש לנו תהליך אובזרבציה הנובע מפרמטר ,Θממנו יוצאים אוסף דוגמאות X1 , X2 , . . . :שבעזרתם מנסים לנחש

את .Θמשם ניתן להגיע לתחזיות או לתובנות על העולם .בשבועות הקרובים נטעם על קצה המזלג איך מחברים

בין נתונים בתורת ההסברות.

• באופן כללי Xתצפית רנדומית שבאה בהתפלגות ) .pX (x, Θמטרה באמידה לגלות את .Θמה היינו רוצים

מ ?Θˆnהוא יהיה פונקציה של .X1 , . . .h, Xniאנחנו רוצים כי כאשר ∞ → nאז Θˆn → Θבהסתברות ־ אומד

קונסיסטנטי .כמו כן כי E Θˆn = Θ־ אומד לא מוטה.

• הנחות:

.X1 , . . . , Xn ∼ X .1

X1 , . . . , Xn .2ב"ת.

הנחות אלו נקראות .i.i.d = identically indepentely distributed

• נרצה לאמוד ) gˆ (X1 , . . . , Xnכאומדן ל־]).E [g (X

14

– דוגמא ,g (X) = X :1אזי ] .E [g (X)] = E [Xנבחר אומד )פונקציה(

P

P

ˆ .האם זה אומד הגיוני?

g = n1 ni=1 g (Xi ) = n1 ni=1 Xi

" n

#

n

X

1

1X

n

ˆ[ E

g] = E

= ) g (Xi

])E [g (Xi )] = E [g (X)] = E [g (X

n i=1

n i=1

n

ולכן ˆ gהינו אומד חסר הטייה .עבור X1 , . . . , Xnמסויימים נקבל אומדן ) gˆnמספר(.

דוגמת הבחירות ,p = E [X] ,X ∼ Ber (p) ,ולכן מטרה pהיא מטרת ] .E [Xדרך למטרה :נשאל הרבה

אנשים ) .X1 , . . . , Xn ∼ Ber (pמפעילים פונקציה )אומד( על התוצאות ,ומקבלים אומדן .ניתן להתווכח

על הבחירה של האומד ,המטרה נתונה.

נחזור לדוגמא :1התנאי כי האומד יהיה קונסיסטנטי מתקבל מהחוק החלש של המספרים הגדולים.

– דוגמא :2שונות ־ ,g (X) = E (X − E [X])2כלומר מחפשים את ) E [g (X)] = σ 2נשתמש ב־

P

µלתוחלת ו־ σ 2לשונות( .נתון שיודעים את .µננסה ־ gˆn = n1 i (Xi − µ)2־ זה קונסיסטנטי.

P

.E [gˆn ] = n1 i E (Xi − µ)2 = nn σ 2 = σ 2

2 1 Pn 2

2

Pn

1

– דוגמא :3כמו 2רק µלא ידוע .במקרה הזה רוצים למצוא

gˆn = n i=1 Xi − Xn = n i=1 Xi − 2Xi Xn + Xn

)נשתמש בפונקציה מדוגמא 1להעריך את התוחלת( .נבדוק סטיה:

2

X

X

h

2

2

2 i

σ

1

1

n−1

2

2

2

2

= σ +µ −

+ µ = σ2

E [gˆn ] = E

Xi − 2 X n + Xn

=E

Xi −E Xn

n

n

n

n

h

2 i

2

,V ar Xn = σn = E Xnולכן יש לנו הטיה באומד .איך ייראה

כי ,σ 2 = E [X 2 ] − µ2ו־ − µ2

2

Pn

1

n

= gˆn ∗ (X1 , . . . , Xn ) = n−1

.gˆn n−1

האומד חסר הטיה?

i=1 Xi − Xn

• אמידת פרמטרים.

2

h

i2

ˆ −Θ

ˆ −Θ + E Θ

ˆ −Θ

Θ

= V ar Θ

– נגדיר גודל הטעות:

h i

) M SE Θˆn = Eכלומר:

השונות של האומד ,בתוספת ההטיה של האומד biasבריבוע( .אנו מעוניינים למזער את ההטיה של

האומד ,ואת השונות שלו ,ובסה"כ את ה־ M SEשלו.

– דוגמא .X ∼ U (0, Θ) :נבדוק את האומדים

הבאיםh :

i

.E Θˆa = 2E Xn = 2E [X] = 2 · Θ2 = Θ :Θˆa = 2Xn

בס"ד ,ט"ז טבת תשע"א :שעור 21

• בבחינה 4דפי נוסחאות .בחינה אמריקאית .יהיה בנק שאלות לדוגמא .אפשר מחשבון ,זה לא יעזור.

• מונחים :מכשיר=פונקציה=אומד.

• נניח כי יש לנו מטבע .Θ = p = 12מדגם ,000101 :1מדגם ,01101 :2מדגם .11111010 :3נעביר כל מדגם

דרך "מכשיר" שמטרתו לנסות לגלות את .Θלמכשירים שמקבלים דברים ומחזירים מספר קוראים פונקציה.

השורה היא של מכשירים זהים ,למכשיר קוראים אומד .היינו משתמשים במכשיר .Xnנקבל , 26 , 64 , 86שהם

אומדנים )ספציפיים למדגם( .אנו רוצים לשאול האם האומד הוא טוב .אומד שהתוחלת שלו שווה לתוחלת

2

h

i2

ˆ

ˆ

ˆ

ˆ

.M SE Θ = E Θ − Θנשים לב

האמיתית ,הוא חסר הטייה .הגדרנו = V ar Θ + E Θ − Θ

כי הוא פונקציה של האומד ושל .Θישנם ערכים של Θעבורם האומד טוב ,וערכים שלא.

15

• דוגמא ,X ∼ (0, Θ) :נאמוד

h i

ΘˆC = 2Xn .1ראינו כי ˆ = Θ

,E Θכלומר הוא חסר הטיה .מה השונות שלו?

2

2

4

).V ar ΘˆC = V ar 2Xn = 4V ar Xn = 4 V ar(X

)= (b−a

= Θ3n

n

12 n

.ΘˆA = max Xi .2בהרבה נסיונות ,נקבל מספר שקרוב ל־ .Θנחשב את הפונקציות:

n

an

a n

=

פונקצית הצפיפות היא .fΘˆn (x) = Θnנחשב

לכן

P

(max

X

i ≤ a) = P (Xi < a) = Θ

n

Θ

´ h i

´ Θ nyn

Θ ny n−1

ny n+1

n

Θ

ˆ

= .E Θnזהו אומד קונסיסטנטי ,אבל מוטה מעט.

את Θ

= y n

= n

= n |0

ny n−1

n+1

Θ

(n+1)Θ

0

Θ

0

השונות שווה ל־ . (n+1)n2 (n+2) Θ2זוהי שונות יותר טובה משל .C

.3

ˆ n+1

ΘA

n

= .ΘˆB

נחשב מה יותר טוב:

גודל קטן יותר.

Θ2

3n

n

2

Θ2

זאת

ולעומת

M

SE

,M SE ΘˆA = ∗ + n+1זהו

= ΘˆC

)Θ − Θ = ∗ + (n+1

2

• שיטת המומנטים .נניח כי ) ,fX (x; θ1 , . . . , θnו־ ) .Θi = g (E [X] , E [X 2 ] , . . .לפעמים מספיק המומנט

הראשון והשני ,לפעמים צריך הרבה.

(x−µ)2

1

– דוגמא X ∼ N (µ, σ 2 ) :אזי e− 2σ2

.fX (x) = √2πσאזי ].Θ1 = µ = E [X

.Θ2 = σ 2 = V ar (X) = E [X 2 ] − E [X]2כבר ראינו איך לחשב את ] .E [X] , E [X 2

.1אומדים את המומנטים שצריכים ע"י סכימה פשוטה וחלוקה בקבוע המתאים.

.2מחשבים את כל הפרמרים מתוך המומנטים.

– דוגמא .V ar [X] = mp (1 − p) ,E [X] = mp .X ∼ Bin (m, p) :בעזרת שני המומנטים הראשונים

ניתן לחלץ את .m, p

– בעיות :ניתן לקבל תוצאות אסורות עבור הפרמטרים ,אם האומדנים למומנטים הם לא טובים ,למשל ניתן

לקבל שונות שלילית.

• נראות מקסימלית Maximum Liklihood

Θמתוך מדגם .נניח יש לנו 1111011בהטלות מטבע .ננסה למצוא ˆ

המשימה לחפש ˆ

Θשמביא את ההסתברות

Qn

לנתוני המדגם למקסימום .למשל אם נתון ,X1 , . . . , Xnננסה למקסם את ) . i=1 P (Xi | Θנעביר ללוג

)פונקציה מונוטונית( .f (Θ) = log (Qn P (Xi | Θ)) = Pn log (P (Xi | Θ)) .נחפש ˆ

Θשממקסם את

i=1

i=1

פונקציית לוג־הנראות.

– דוגמא .X ∼ Ber (Θ) :אזי .P (Xi = 1; Θ) = Θמקבלים .X1 , . . . , Xnפונקציית לוג הנראות היא

])[Xi log (Θ) + (1 − Xi ) log (1 − Θ

n

X

=

1−Xi

)(1 − Θ

Xi

log Θ

i=1

Xi

n

X

i=1

n

X

i=1

= )log (1 − Θ

X

i,Xi =0

log Θ +

X

i,Xi =1

n

X

Xi 1 − Xi

1

−

= = 0 ⇒ Θˆn

Θ

1−Θ

n

אומד נראות מירבית הוא תמיד קונסיסטנטי .וכן )( .Θn −−−→∼ N

∞→n

16

i=1

= )f (Θ

= )f 0 (Θ

– דוגמא :משתנה אקספוננציאלי .לקוחות מגיעים לחנות כך שלקוח iמגיע בזמן Yiומניחים שהמרווחים

Yi − Yi−1מתפלגים אקספוננציאלי.Y0 = 0 .

Q

נסמן ב־ Xiאת המרווח .רוצים למצוא את .fX (D; Θ) = i Θe−ΘXi .Θלכן

P

ˆ = Pn .l (D; Θ) = Pn log Θ + Pn −ΘXi

.l0 (D; Θ) = Θn − ni=1 Xi = 0 ⇒ Θ

i=1

i=1

Xi

בס"ד ,י"ט טבת תשע"א :שעור 22

• נראות מרבית ־ קלט X1 , . . . , Xn :מניחים ,i.i.d.מניחים מנגנון שייצר את הדוגמאות ) pX (x; θאו ).fX (x; θ

θלא ידוע .פלט θˆ :שבמובן מסויים קרוב ל־ .θמחפשים את ).argmaxP (X1 , . . . , Xn ; θ

(Xi −µ)2

Q

1

.P (X1 , . . . , Xn ; θ) = ni=1 √2πσנמקסם את

• דוגמאe− 2σ2 .X ∼ N (µ, σ 2 ) :

2

P

P

P

P

)i −µ

∂ logכלומר

.log P () = ni=1 − 21 log 2πσ 2 + ni=1 (X2σלכן = − 2σ2 2 ni=1 (Xi − µ) = 0

2

∂µ

P

nµ = ni=1 Xiאו .µ = Xnע"פ משפט הגבול המרכזי .Xn −−−→∼ Nנגזור לפי :σ 2

∞→n

n

n

n

X

1

1 X

1X

∂ log P

2

2

=

+ 4

= (Xi − µ) = 0 ⇒ σ

(Xi − µ)2

2

∂σ 2

σ

2σ

n

i=1

i=1

i=1

.

• מרווח סמך ־ .Condence Interval

נניח ) .X ∼ (µ, 1מדגם מקרי .X1 , . . . , X4נבחר את המרווח .µ ∈ X − 1, X + 1מה הסיכוי ש־ µבקטע

הזה?

= = P µ − 1 ≤ X ≤ µ + 1 = 1 − 2P X ≥ µ + 1 = 1 − 2 1 − P X ≤ µ + 1

= 2P 2 X − µ ≤ 2 − 1 = 2 · 0.9772 − 1 = 0.954

P X −1≤µ≤X +1

ז"א אם X = 3.5אז ] µ ∈ [2.5, 3.5בסיכוי .95%־ לא .ל־ µאין אקראיות .אלא X − 1, X + 1כולל את

µבסיכוי .95%

נקבע רמת בטחון ,נחשב רווח סמך X ∼ N (µ, σ 2 ) :כאשר σ 2ידוע .נסמן P (Z ≤ zp ) = pכאשר

) p ,Z ∼ N (0, 1רמת הבטחון הנדרשת ,ו־) .zp = Φ−1 (pלמשל .z0.975 = 1.96

h

i

משפט µ ∈ X − √σn z1− α2 , X + √σn z1− α2 :ברמת סמך .1 − α

למשל עבור .z1− α2 = 1.96 ,1 − α2 = 0.975 ,α = 0.05ולכן אם ,X = 33.19, σ 2 = 1118.33, n = 100קל

להציב בנוסחא ולגלות את רווח הסמך.

הוכחה:

Xn − µ

Xn − µ

√ ≤ z1− α2 = 1 − 2P

= √ ≥ z1− α2

≤ = P −z1− α2

σ/ n

σ/ n

Xn − µ

α

√ ≤ z1− α2

= 1−2 1−P

=1−2 1− 1−

=

2

σ/ n

= 1−α

σ

σ

X − √ z1− α2 ≤ µ ≤ X + √ z1− α2

n

n

מה אם רוצים מרווח ,εאבל ברמת ביטחון , √σn z1− α2 ≤ ε ?1 − αכלומר

17

2

σ 2 z1−

α

2

ε2

≥ .n

P

לתוחלת .Xnבקירוב עבור nגדול,

דוגמא:

) .X ∼ Ber (pנתונים X1 , . . . , Xnמדגם .מטרה :רווחqסמך

) ,Xn ∼ N p, p(1−pולכן רווח הסמך הוא z1− α2

מתקיים

) p ∈ Xn ± p(1−pברמת סמך ) 1−αבמקורב(.

n

n

בעיה :יש לנו pבתוך הביטוי.

h

i

פתרון א' .p (1 − p) ≤ 14 :לכן נקבע .p ∈ Xn ± 2√1 n z1− α2

q

) Xn (1−Xn

.p ∈ Xn ±עכשיו יש לנו שני

פתרון ב' :נשתמש באומד ל־ ,pןנציב ,X 1 − Xונקבל z1− α2

n

קירובים.

פתרון ג' :נשתמש באומד של .σˆ2

• רמת סמך להפרש תוחלות .נניח ) X ∼ N (µ1 , σ12 ) , Y ∼ N (µ2 , σ22ב"ת .רוצים רווח סמך ל־ .µ1 − µ2רוצים

פערים בין אוכלוסיות .ננסה להגדיר אומד .Xn − Yn :מליניארוית התוחלת זהו אומד לא מוטה.

לבדוק אם יש

σ 2 +σ 2

) W = X − Y ∼ N µ1 − µ2 , 1 n 2בהנחה שהמדגמים שווים בגודלם( .ניתן כעת להשתמש במשפט.

בס"ד ,כ"ג טבת תשע"א :שעור 23

• שיעור אחרון ־ חזרה על חומר .תרגול אחרון יוקצה להכנה לבחינה.

• מדגם :i.i.d.

.1מניחים ).pX (x; θ) , fX (x; θ

.2מפעילים מכשירים שונים )אומד ,נוסחת רווח סמך(.

.3מקבלים אומדן ,רווח סמך קונקרטי.

.4נזכור כי אם ) ) X ∼ N (µ, σ 2כשהשונות ידועה(,

i

√σ z1− α

n

2

h

¯±

µ ∈ Xברמת ביטחון .1 − α

• רווח סמך חד צדדי¯ +c :

,µ ≤ Xננסה .µ ≤ X + √σn z1− α2 ,האם זהו רווח סמך ברמת סמך ?1−αצריך לבדוק

ולחשב את רווח הסמך .למעשה זה יהיה רמת סמך . α2אם רוצים רמת סמך αצריך לחשב .µ ≤ X + √σn z1−α

√

√

√

nc

nc

=

Φ

=

1

−

α

כלומר

P

µ

≤

≥

−

X

+

c

אנו רוצים = 1 − α

,P Xσ/n√−µכלומר ,z1−α = σnc

σ

σ

n

או .c = √σn z1−αלכן עבור ,α = 0.05נקבל .z0.95 = 1.645

• דוגמא לא סימטרית :נניח ) .X ∼ U (0, θיש לנו אומד θˆ = max Xiעם הטיה .נחפש kכך ש־

max Xi

≤ P max Xi ≤ θ

= )= P (kθ ≤ max Xi ≤ θ) = P (kθ ≤ max Xi ) = 1 − P (max Xi ≤ kθ

k

\

= 1−P

Xi ≤ θ = 1 − P (X ≤ kθ)n = 1 − k n = 1 − α

√

כלומר .k = n αכלומר יש לנו רווח סמך

את המדגם ,נקטין את הרווח(.

max

Xi

√

nα

≤ max Xi ≤ θברמת ביטחון של ) .1 − αככל שנעלה יותר

• הצורה הכללית של רווח סמך רציף.f (X1 , . . . , Xn ) ≤ θ ≤ g (X1 , . . . , Xn ) :

• בדיקת השערותHypothesis Testing :

נניח X ∼ FXמניחים השערת אפס ,H0 : F = F0 ,והשערה אלטרנטיבית ,H1 : F = F1ובעזרת דגימות נבדוק

איזו יותר טובה.

18

– מרחב הדגימות :מרחב מופשט רב־ממדי שממנו באות דגימות אקראיות .בתוכו יש איזור Rשבו נדחה

) (Rejection Regionאת ,H0ואיזור Rcשבו נקבל ) (Acception Regionאת .H0למשל עבור H0

מטבע מוטה ,ו־ H1מטבע לא מוטה ,עבור HHT HHT Hרוב האנשים יאמרו לא מוטה ,ובכל מקרה

,T T HHT HHT H ∈ Rcו־ HHHHHHHHT ∈ Rלכל הדעות .יש לנו שני סוגי טעויות:

.false rejection, false positive

נגדיר )) α = PH0 ((X1 , . . . , Xn ) ∈ Rהסתברות לטעות מסוג ראשון או רמת המובהקות של המבחן(,

) 1 − β = 1 − PH1 ((X1 , . . . , Xn ) ∈ Rcהעוצמה של המבחן.

דוגמא .H0 : µ = 3, H1 : µ = 5 ,X ∼ N (µ, 1) :אפשר לאמוד את µולהחליט למי יותר קרוב ,או בדרך

אחרת.

ננסה מבחן Xn < 17קבל H0־ כמעט תמיד נקבל .האפשרות ל־ false rejectionהיא קטנה ביותר ,אבל

האפשרות לטעות מסוג שני היא גבוהה .נחשב את αו־ βעבור :Xn < 3.5

√

n

α = PH0 Xn ≥ 3.5 = 1 − Φ

2

√

√

√

β = PH1 Xn < 3.5 = P

n Xn − 5 < −1.5 n = 1 − Φ 1.5 n

√

לעומת זאת אם נגדיל את המבחן ל־ Xn < 4.5נקבל,α = PH0 Xn ≥ 4.5 = 1 − Φ 3 2 n :

√

√

√

.β = PH1 Xn < 4.5 = P

)n Xn − 5 < −0.5 n = 1 − Φ (0.5 n

√

קביעת αמראש :נגדיר מבחן .Xn < cמהו α = PH0 Xn ≥ c ⇒ z1−α = n (c − 3) ?cומכאן ניתן

לחלץ את .cמה זה אומר על ?βככל שננמיך את αנעלה את .βמה כאשר רוצים αאו פחות ,ו־ βאו פחות.

ניתן לשפר את המצב ע"י הגדלת המדגם.

בס"ד ,כ"ו טבת תשע"א :שעור 24

H : µ = µ

0

0

.מבחן:

• דברנו על בדיקת השערות .דוגמא X ∼ N (µ, σ 2 ) :כאשר σידוע, µ1 > µ0 .

H : µ = µ

1

1

)√ 0 ≤ c (n

Xσ/n −µ־ קבל .H0המטרה :רמת מובהקות )הסתברות לדחייה שגויה( ,αועוצמה )β־ הסתברות

n

לקבלה שגויה( .1 − β

.1תנאי א'.c (n) ≥ z1−α :

.2תנאי ב'≤ c (n) ≤ β :

0 −µ

√ 1 ≤ zβ

.c (n) + µσ/

n

Xn −µ

√ 0

σ/ n

.PH1זה זהה ל־≤ β

µ0 −µ

√1

σ/ n

.P Z ≤ c (n) +כלומר

2

מצירוף שני התנאים נקבל כי ≤ zβ

שיעמוד בתנאים.

) (X=x

P

µ0 −µ

√1

σ/ n

Qn

.z1−α +כלומר

) σ 2 (z1−α −zβ

(µ0 −µ1 )2

≥ .nלאחר מכן ניתן לחפש )c (n

• מבחן יחס הנראות : Qni=1PHH1 (X=xii ) ≥ 1 :בודקים את היחס בין פונקציות הנראות של כל אחת מההשערות,

i=1

01

אם הוא גדול מ־ 1דוחים את .H0מה קורה אם משווים מול קבוע ?Cאם C > 1מקטינים את טווח הדחייה,

כלומר מקטינים את .αאם לוקחים C < 1מגדילים את טווח הדחייה ,ומקטינים את .β

19

– נתונה קוביה:

1

6

= ).H0 : pX (x

x = 1, 2

1.5

x = 1, 2

1

x = 3, 4, 5, 6

1

4

= ) .H1 : pX (xמהו יחס הנראות לדוגמא

8

= ) .L (xננסה לבחור .Cבחירות טבעיות :עבור C ≤ 0.75יש לנו

בודדת?

0.75 x = 3, 4, 5, 6

דחייה קבועה ,עבור 0.75 < C ≤ 1.5נדחה אם התוצאה תהיה 1או ,2ונקבל אחרת .עבור 1.5 ≤ C

תמיד נקבל) .שתי האפשרויות הקיצוניות לא יעילות כמבחן(.

• משפט ניימן־פירסון :נתון ערך קריטי Cוסטטיסטי מבחן ) R .L (X1 , . . . , Xn־ איזור הדחייה כאשר

) P (X ,...,X

.L (X1 , . . . , Xn ) = PHH1 (X11 ,...,Xnn ) ≥ Cנסמן ב־) ,α = PH0 (Rו־) .1 − β = PH1 (Rנתון מבחן אחר.

0

נסמן ב־ Sאת קבוצת הדחייה .ב־) .α0 = PH0 (S) , 1 − β = PH1 (Sאזי :אם ,α0 < αאז 1 − β 0 < 1 − β

)אי אפשר לשפר את היחס בין αל־ βע"י בחירת מבחן אחר .תמיד מבחן יחס הנראות יהיה הכי טוב(.

• :P − V alueנתון סטטיסטי מבחן ) .w (X1 , . . . , Xnוכלל דחייה מצורת .α (C) = PH0 (w ≥ C) .w () ≥ C

קבלנו מדגם ספציפי .מתוכו יש לנו ˆ .wמגיע מדגם חדש .האם הוא "יותר קיצוני" מהמדגם הקודם? )כלומר יותר

רחוק מ־ .(H0נשווה בין wˆAו־ .wˆBאם השני גבוה יותר ,הוא יותר קרוב לאיזור הדחייה .מה ההסתברות שמדגם

מקרי יהיה יותר קיצוני מזה שהוביל ל־ ?wˆAפורמלית נרשום את ההסתברות .P (w (X1 , . . . , Xn ) ≥ wˆA ) = ε

ככל ש־ εקטן ,יותר קשה לראות מדגם שערך הסטטיסטי שלו גדול יותר.

כעת נגדיר :ערך pשל המדגם ) .Pv = PH0 (w (X1 , . . . , Xn ) ≥ wˆA ) = α (wˆAזוהי פונקציה של מדגמים.

פרשנות :הסתברות לקבל מדגם קיצוני כמו זו שהתקבלה או יותר ,תחת .H0

בס"ד ,ר"ח שבט תשע"א :שעור 25

• בדיקת השערות סטנדרטית :נתון מדגם .i.i.d. X1 , . . . , Xnהגדרנו סטטיסטי מבחן ) .w (X1 , . . . , Xnהשוונו

את )( wלערך של ,cודחינו את H0אם α .w () > cביחס הפוך ל־) .cראינו כמה כיוונים לקבוע חלק

מהנתונים ולחלץ את האחרים(.

ˆ .נניח שלא קבענו סף cמראש .כמה מדגמים יהיו יותר

• :P-valueקבלנו ממדגם מסויים ) c = wˆ (X1 , . . . , Xn

קיצוניים? ))( ˆ .Pv (x1 , . . . , xn ) = PH0 (w () ≥ wככל ש־ Pvגבוה יותר ,זו סיבה לקבל את .H0

– למשל מטבע .H0 : p = 0.5, H1 : p = 0.9 ,המדגם הוא " .1, 1, 1, 1, 0, 1כנראה" .H1ניתן לבדוק מה

הסיכוי לראות מדגם שפחות מתאים ל־ ) H0מדגם יותר קיצוני(.

5

6

1

7

=

+1

=

= 0.11

≥ Pv (1, 1, 1, 1, 0, 1) = PH0 (w (X1 , . . . , X6 ) ≥ wˆ (1, 1, 1, 1, 0, 1)) = PH0 X6

6

5

64

64

– ניתן לקבוע מבחן :נדחה את H0אם Pv () ≤ εשזה שקול אם היינו קובעים את Cכך ש־.α = ε

– סיבה :הגדרה יותר אינטואיטיבית לבדיקת השערות .נזכור כי Pvמתפלג אחיד.

• בדיקת השערות מורכבות .composite hypothesis testing

– למשל ) ,X ∼ N (µ, σ 2עם .H0 : µ = µ0 , H1 : µ > µ0ניקח את הסטטיסטי והמבחן √ 0 ≥ z1−α

. X−µ

σ/ n

זה שקול ל־ .µ0 ≤ X − √σn z1−αכלומר רווח סמך חד צדדי.PH0 (w () > z1−α ) = α .

√ 0 ≥ z1−α

.1 − β = PH1 X−µאם היינו משנים את H1ל־ µ 6= µ0היינו מקבלים רווח סמך דו"צ.

σ/ n

20

• תהליכים מרקוביים )מכאן לא למבחן(

דוגמא :שירות לקוחות מתעניינים במספר האנשים בתור .יודעים שבכל דקה יש הסתברות pללקוח חדש .מה

הסיכוי ל־ kלקוחות אחרי nדקות.

בעולם יש } {1, . . . , mמצבים )נעבוד רק עם דברים סופיים( .הנחת המרקוביות היא = ) P (Xn+1 | X0 , . . . , Xn

) .P (Xn+1 | Xnכאשר Xnהוא מצב העולם בשלב .nנגדיר X0־ מצב התחלתי נתון או הסתברות עליו.

– נניח שיש לנו גרף מצבים } {−2, −1, 0, 1, 2עם מטריצת מעבר

2

1

1

4

3

4

1

4

1

2

1

4

0

1

4

1

2

1

4

-1

-2

1

4

1

2

1

4

3

4

1

4

-2

-1

0

1

2

עלינו למצוא את ) .P (Xn = i | X0 = 0יש כמה דברים שעלינו לברר:

.1האם זה מתכנס?

1

2

זמן

0

1

2

3

n

n+1

-1

-2

0

1

16

1

4

1

4

1

2

3

8

1

4

1

4

1

16

2

7

1

7

1

7

1

7

2

7

1

2

7

n

n+1

<

1

5

1

5

1

5

1

5

1

5

1

5

1

5

1

5

1

5

1

5

אם זה יתכנס למשהו לא אחיד ־ תמיד יהיה שוני בשלב הבא.

.2לאן?

.3כמה מהר?

– מה קורה בהתכנסות? Πj־ ההסתברות להיות במצב jכאשר ∞ → .(Steady-state distribution) n

P

Pm

Πi = m

= ) .P (Xn+1 = iבאיזון נקבל j=1 Πj Pj→i

באופן כללי )j=1 P (Xn = j) P (Xn+1 = i | Xn = j

כאשר ).Pj→i = P (Xn+1 = i | Xn = j

בס"ד ,ד' שבט תשע"א :שעור 26

• תהליכים מרקוביים:

.1יש מצבי עולם }.{1, . . . , m

21

)א( יש הסתברות למעבר בין מצבי העולם ) P (Xn+1 = i | Xn = j) = pji = pj→iהנחות :הכל בדידpji ,

לא משתנה בזמן )הומוגני((.

)ב( X0נתון או הסתברות.

P

• הגדרה :התפלגות סטציונארית) (∀j) , Πj = i Πi pij :בעצם )P (Xn = i) P (Xn+1 = j | Xn = i

־ תנאי דינמיקה כללי ,תמיד נכון מנוסחת ההסתברות השלמה(.

i

P

= )P (Xn+1 = j

– דוגמא :לפרופסור מפוזר שתי מטריות שהוא משתמש בהם בדרך לעבודה או חזרה .אם יורד גשם

)בהסתברות (pויש מטריה לידו הוא לוקח אותה ,אחרת הוא שוכח את המטריה .מה הסתברות

ההירטבות לאורך זמן? מצבי העולם :מספר המטריות לידו } .{0, 1, 2צעד בין מצבים :ממצב 0תמיד

נעבור בהסתברות 1למצב .2ממצב 2נעבור בהסתברות pלמצב ,1ובהסתברות 1 − pלמצב .0ממצב 1

נעבור למצב 2בהסתברות ,pונישאר במצב בהסתברות .1 − pננסה לשלוף את ההתפלגות הסטציונרית:

Π0 = (1 − p) Π2

Π1 = (1 − p) Π1 + pΠ2

Π2 = Π0 + pΠ1

1−p

= Π0

3−p

1

= Π1 = Π2

3−p

• הגדרות:

.1מצב iייקרא נגיש accessibleמ־ jאם קיים nכך ש־.P (Xn = i | X0 = j) > 0

.2מצב iנקרא recurrentאו חוזר על עצמו אם iנגיש מכל jשנגיש מ־.i

.3אם 2לא מתקיים המצב נקרא ) transientחולף(.

• משפט :נסמן ב־) A (iאת אוסף המצבים הנגישים מ־) iכולל אולי iעצמו( .אם iהוא recurrntאזי

) A (i) = A (jלכל jנגיש ממנו .המחלקה ) A (iנקראת .recurrent class

נגביל את עצמנו לתהליכים עם מחלקת recurrentאחת .אנו מחפשים התפלגויות שאינן תלויות ב־ ,nואינן

תלויות ב־ .X0

• מחלקה תיקרא מחזורית אם ניתן לחלק את המצבים בה ל־ S1 , . . . , Skכך שמכל Siעוברים בהסתברות 1

ל־ Sjאחר.

• משפט :אם ב־ M Cיש מחלקה אחת לא מחזורית אזי קיימת התפלגות סטציונארית יחידה שלא תלויה ב־ X0

כך ש־ Πj = 0עבור כל מצב טרנזינטי ,ו־ Πj > 0עבור כל מצב שהוא במחלקה.

– דוגמא עובד בעל אמונות טפלות עובד בבניין מעגלי עם ) mאי־זוגי( דלתות ,בהסתברות pלדלת קדימה,

ו־ 1 − pלדלת אחורה .אם p = 0, 1זו תהיה מחזוריות בין mהדלתות ,ואם mזוגי ,תהיה מחזוריות בין

הדלתות עם מספר זוגי לדלתות עם מספר אי זוגי .יש לנו mמשוואות) Πi = Πi−1 p + Πi+1 (1 − p) :עם

22

שינויים ב .(1, mמשיקולי סימטריה ,נבחר

ההתפלגות היחידה.

1

m

= ,Πiונוודא שזה מקיים את המשוואות .לפי המשפט זוהי

• משפט החתך :נניח שניתן לחלק את אוסף המצבים ל־ S1 , S2חלוקה זרה עם מעברים ביניהם .נגדיר

P

ΠS1 = i∈S1 Πiאזי .ΠS1 · P (S1 → S2 ) = ΠS2 · P (S2 → S1 ) :

– תהליך לידה\מוות הוא כזה שמכל מצב אפשר לעבור רק למצב "שכן".

)bi = P (Xn+1 = i + 1 | Xn = i) , di = P (Xn+1 = i − 1 | Xn = i

לפי משפט החתך ,מתקיים .Πi bi = Πi+1 di+1

הוכחה Π0 (1 − b0 ) + Π1 d1 = Π0 :לפי הגדרה .כלומר .Π0 b0 = Π1 d1באופן דומה

,Π1 = Π0 b0 + Π1 (1 − b1 − d1 ) + Π2 d2ומכאן .Π2 d2 = Π1 b1ניתן להמשיך באינדוקציה .עבור משפט

החתך עצמו יש לבצע את כל החישוב על סכום עבור כל המצבים ב־ .S1 , S2

תרגולים:

בס"ד ,ז' כסלו תשע"א :תרגול 6התפלגות משותפת

פונקצית הסתברות משותפת P (X = x, Y = y) = PX (x) PY (y) :עבור ב"ת.

)=y

.P (X = x | Y = y) = P (X=x,Y

הסתברות מותנית:

)P (Y =y

P

P

הסתברות שולית.pX (x) = y pX,Y (x, y) = y P (X = x | Y = y) pY (y) :

P

P

תוחלת מותנית .E [X | Y = y] = x xpX,Y =y (x) :וכן ).E [E [X | Y ]] = y E (X | Y = y) pY (y

דוגמא .Y | X ∼ Bin (x, p) ,X ∼ Geo (p) :מה ההתפלגות )?pY (0

P

P

∞P

2x

x

x−1

∞ =p

∞ = )pY (0) = x=1 P (Y = 0 | X = x) P (X = x

x=0 q

x=1 q pq

דוגמא :סוחר בבורסה קונה 100מניות מסוג Aומאתיים מסוג .Bנגדיר X־ שינוי יומי אבסולוטי של מחיר מניה

Y .A־ למניה X, Y .Bמפולגים בצורה אחידה על התחום .−1 < y − x < 1 ,−2 < x < 4

4

0

0

0

0

3

0

0

0

0

2

0

0

0

0

0

0

0

1

21

1

21

1

21

1

21

1

21

1

21

1

21

1

21

1

21

0

0

0

1

0

0

0

1

21

1

21

1

21

0

0

0

0

0

0

1

21

1

21

1

21

0

0

0

0

-2

1

21

1

21

1

21

0

Y/X

-3

-2

-1

0

-1

0

0

0

0

0

0

0

0

0

0

0

1

2

3

4

5

1

21

1

21

1

21

y = −3, 5

נסכום כל ערך בטבלה ,או כל שורה וכל עמודה .ונראה כי

1

7

= ) ,pX (xאולם

y = −2, 4

1

21

2

21

1

−1 ≤ y ≤ 3

) X ∼ U (−2, 4ולכן .E [X] = 1אך גם ,E [Y ] = 1ולכן תוחלת הרווח ליום היא .100 + 200 = 300

23

7

= ).pY (y

דוגמאn + 1 :כדים ממוספרים 1, 2, . . . , n + 1כך שבכד iיש iכדורים לבנים והשאר שחורים ובסה"כ n + 1

כדורים בכל כד .מטילים מטבע עם הסתברות pלעץ nפעמים .אם התקבלו kעצים בוחרים את כד .k + 1מוציאים

x+1

כדורים עם החזרה עד לקבלת לבן .מהי תוחלת מספר ההוצאות .בקיצור,X ∼ Bin (n, p) :

.Y | X ∼ Geo n+1

?= ] E [Y

Pn

Pn

n x n−x x+1 n−x y−1

תשובה:

.pY (y) = x=0 P (Y = y | X = x) pX (x) = x=0 x p q

n+1 n+1

∞P

Pn

Pn

Pn

∞n x n−x P

n x n−x n+1

n+1 x+1 n−x

x+1 n−x y−1

1

E [Y ] = y=1 ypY (y) = x=0 x p q

p q

= x=0 x p q

=

y=1 y n+1 n+1

x=0

x+1

x+1

p

בס"ד ,י"ד כסלו תשע"א :תרגול 7

מ"מ רציפים

∞´

Xמ"מ רציף עם פונקצית צפיפות ) .fX (xמקיימת −∞ fX (x) dx = 1ו־ .fX (x) ≥ 0יש לנו פונקצית התפלגות

∞´

∞´

´x

מצטברת ,FX (x) = P (X < x) = −∞ fX (t) dtתוחלתE [X 2 ] = −∞ x2 fX (x) dx ,E [X] = −∞ xfX (x) dx :

∞´

או באופן כללי .E [g (x)] = −∞ g (x) fX (x) dx

0

x<0

דוגמא X :מ"מ רציף עם .FX (x) = xn 0 ≤ x < 1 ,(Commulative D Function) CDFעבור .n > 0אזי

1

x≥1

0

x<0

´ 1 n−1

1

,fX (x) = F 0 (x) = nxn−1 0 ≤ x < 1נראה כי זו צפיפות 0 nx dx = [xn ]0 = 1 :התוחלת

0

x≥1

1

´

´

1

1

n

n

n

E [X 2 ] = 0 x2 nxn−1 dx = n+2ולכן

.E [X] = 0 xnxn−1 dx = n+1השונות:

xn+1 0 = n+1

2

n

n

.V

ar

)(X

=

−

n+2

n+1

3+ax2 0 < x < 1

b

דוגמא:

= ) E [x] = 85 ,fX (xחשב את a, bואת ) .V ar (xנפתור שתי משוואות:

0

ˆ1

a

1

3+

= dx

b

3

3

2

3 + ax

1

= 1

b

0

a

3

3 a

+

2 4

1

= dx

b

b = 3+

ˆ1

3x + ax

5

1

=

8

b

0

b = 6

a = 9

ולכן

0<x<1

1 + 3 x2

,fX (x) = 2 2

0

3

10

+

1

6

= + 32 x4 dx

טענה :לכל משתנה מקרי Xאי שלילי (1 − FX (x)) dx

24

∞´

0

´ 1 x2

2

0

= ] E [X 2

= )E (X

הוכחה :עבור מ"מ בדיד )טבעיים(

∞ X

∞

X

= )pX (i

= )P (X > x

x=0 i=x+1

∞

X

= ))(1 − P (X ≤ x

x=0

∞

X

= ]E [X

x=0

= = pX (1) + pX (2) + pX (3) + . . . + pX (2) + pX (3) + . . . + pX (3) + . . .

∞

X

= = 1 · pX (1) + 2pX (2) + . . .

]xpX (x) = E [X

x=0

עבור המשתנים הרציפים:

∞ˆ

]fX (t) tdt = E [X

ˆt

= dxdt

0

∞ˆ

)fX (t

0

ˆ∞ ˆ t

= fX (t) dxdt

0

∞ˆ ∞ˆ

= (1 − FX (x)) dx

= fX (t) dtdx

0

0

∞ˆ

x

0

0

בס"ד ,כ"א כסלו תשע"א :תרגול 8

• צפיפות משותפת מותנית:

– תזכורת X, Y :מ"מ רציפים ,נסמן את פונ' הצפיפות המשותפת של Xו־ .fX,Y (x, y) :Yאם X, Yב"ת

´

´

אזי ) .fX,Y (x, y) = fX (x) fY (yובכל מקרה .fX (x) = y fX,Y (x, y) dy = y fX|Y =y (x) fY (y) dy

f

)(x,y

כאשר ההגדרה של צפיפות מותנית היא:

.fX|Y =y (x) = X,Y

)fY (y

– דוגמא :נתון מקל באורך ,lשוברים אותו בנקודה אקראית )מפילוג אחיד( ונסמן Y־ אורך המקל מהקצה

השמאלי ועד הנקודה .שוברים את המקל הקטן ,ונסמן X־ אורך המקל השמאלי שנותר לנו ביד .נחשב

את ) .E [XY ] ,E [X] ,fX (x) ,fX,Y (x, yנזכור כי )X | Y = y ∼ U (0, y) ,Y ∼ (0, l

1 0<x<y <l

∗ fX,Y (x, y) = fX|Y =y (x) fY (y) = yl1או ליתר דיוק:

.fX,Y (x, y) = yl

0 otherwise

´l

´l

∗ .fX (x) = x fX,Y (x, y) dy = 1l x y1 dy = 1l ln xl

´l

∗ .E [X] = 0 xl ln xl dxנשתמש בתכונה של ]] .E [X] = EY [EX [X | Yולכן E [X | Y = y] = y2

ונקבל .E [X] = E Y2 = 4l

´l´y

∗ ,E [XY ] = 0 0 ly1 xydxdyאבל נשתמש בתכונה של ]] ,E [XY ] = E [E [XY | Yכאשר

h 3 il

h 2i

´l

2

,E [Y | Y = y] = yולכן .E [XY ] = E [Y E [X | Y ]] = E Y2 = 2l1 0 y 2 dy = 2l1 y3 = l6

0

– דוגמא :אתם מגיעים לקניון ומבקרים במספר מקרי Nשל חנויות .בכל אחת מהחנויות אנחנו מבזבזים

P

Xiכסף .נסמן .T = ni−1 Xiנניח nשלם וחיובי .נניח Xiב"ת שווי התפלגות עם ] E [Xו־)V ar (X

נתונים ,ובנוסף כולם ב"ת ב־ .N

טענה.V ar (T ) = V ar (X) E [N ] + E 2 [X] V ar (N ) .E [T ] = E [X] E [N ] :

P

P

P

]] E [T ] = E [ Xi ] = E [E [ Xi | Nאבל ] ,E [ Xi | N ] = nE [Xולכן

] .E [T 2 ] = E [E [T 2 | N ]] .E [T ] = EN [nE [X]] = E [X] E [Nהחלק הפנימי הוא

25

2

E T |N

= E

hX

Xi

X

i

X

Xj = nE X 2 +

E [Xi ] E [Xj ] = nE X 2 + n (n − 1) E 2 [X]

i6=j

E T 2 = E nE X 2 + n (n − 1) E 2 [X] = E [N ] E X 2 + E N 2 E 2 [X] − E [N ] E 2 [X] =

= E [N ] V ar (X) + E N 2 E 2 [X]

V ar (T ) = E T 2 − E 2 [T ] = E [N ] V ar (X) + E N 2 E 2 [X] − E 2 [X] E 2 [N ] =

= E [N ] V ar (X) + E 2 [X] V ar (N )

־ טרנספורמציות של מ"מ9 תרגול: ה' טבת תשע"א,בס"ד

−1 .fY (y) = fX (g −1 (y)) ∂g ∂y(y) : אז, טרנ' מונוטוניתY = g (X) , מ"מ רציףX אם:• טענה

.E [Y ] נחשב את.Y = ln

g (x) = ln

1

(1 − x)3

1

(1−x)3

,X ∼ U (0, 1) :• דוגמא

y

1

− y3

⇒ g −1 (y) = 1 − e− 3

3 ⇒ 1−x = e

(1 − x)

1 e− y3 y ≥ 0

1

ולכן,fX (x) = 1

.E [Y ] = 3 ולכן,Y ∼ exp 3 כלומר.fY (y) = 3

0

= y ⇒ ey =

,0 ≤ 1 ≤ 0 אבל נשים לב כי. זוהי טרנספורמציה לא מונוטוניתY =

FY (y) = P (Y ≤ y) = P

p

|x| ,X ∼ U (−1, 1) – אבל אם

ו־

p

|x| ≤ y = P |X| ≤ y 2 = P −y 2 ≤ X ≤ y 2 = FX y 2 −FX −y 2 = y 2

.fY (y) = 2y ולכן

: תכונות.X היא הפי"מ שלmX (s) = E [esx ] אז, מ"מX :• פונקציות יוצרות מומנטים

.E X k =

∂mX (s)

|s=0

∂sk

.1

.mY (s) = esb mX (at) אזY = aX + b אם.2

Q

P

.((mX1 (s))n )אם הם ש"ה אז זה.mY (s) = mXi (s) אזY =

Xi ו־, ב"תX1 , . . . , Xn אם.3

?mY (s) מהי.Y =

P

Xi ו־,N ∼ P ois (λ) ,Xi ∼ Ber (p) מ"מ ב"ת ש"ה כך ש־,X1 , . . . , XN :– דוגמא

26

mY (s) = E X Y s = E E eY s | N

mXi (s) = (mX1 (s))N = (1 − p + pes )N

N

Y

= )(s

Xi

mPN

i=1

=

|N

Ys

E e

i=1

∞

h

i X

Ys

λn

s N

= ) mY (s) = E E e | N = E (1 − p + pe

= e−λ (1 − p + pes )n

!n

n=0

)s −1

s

= e−λ eλ(1−p+pe ) = eλp(e

∞

X

(λ − λp + λpes )n

!n

= e−λ

n=0

)⇒ Y ∼ P ois (λp

)∂mY (s

s

= ] E [Y

|s=0 = λpeλp(e −1) |s=0 = λpe0 = λp

∂s

• קונבולוציה :אם X, Yמ"מ ב"ת ,Z = X + Y ,אז fX (x) fY (z − x) dx

´

x

P

– דוגמא X1 , . . . , Xn :ב"ת כך ש־ ) Xi ∼ P ois ( λi ) ,Xi ∼ P ois (λi

= )fZ (z

P

= .Y

הוכחה באינדוקציה :עבור ,Y = X1 + X2 ,n = 2לפי נוסחת הקונבולוציה,

y

e−(λ1 λ2 ) X y k y−k

λ2y−k

(λ1 + λ2 )y

=

) λ1 λ2 = e−(λ1 +λ2

!)(y − k

!y

k

!y

k=0

k

−λ1 λ1 −λ2

e

!k

e

y

X

k=0

= )pX1 (k) pX2 (y − k

∞

X

= )pY (y

k=0

P

P

,Y = ni=1 Xi = Xn + n−1כאשר

ולכן ) .Y ∼ P ois (λ1 + λ2נניח נכונות עבור i=1 Xi :n − 1

Pn−1

Pn−1

Pn

Xi ∼ P ois

i=1לפי הנחת האינדוקציה ,ולכן ) Y ∼ P ois ( i=1 λiלפי הבסיס של חיבור

i=1 λi

2משתני פואסון.

בס"ד ,י"ב טבת תשע"א :תרגול 10

• התפלגות נורמלית ) .Z ∼ N (0, 1באופן כללי ) .X ∼ N (µ, σ 2

(x−µ)2

X−µ

σ

= .X = σZ + µ ⇔ Zראינו את

1

.FZ (z) = P (Z ≤ z) = Φ (z) ,fX (x) = √2πσ

פונקצית ההתפלגות e− 2σ2

X−µ

49−53

√

.P (X < 49) = P

דוגמא< 4 = Φ (−2) = 1 − Φ (2) = 1 − 0.9772 = 0.0228 .X ∼ N (53, 4) :

σ

נתון כי ) ,P (Z < t) = 0.8461 = Φ (tמצא את .t = 1.02 :t

אם ) ,X ∼ (µ, 52ונתון כי .FX (23) = 0.9591

.P (X < 23) = P X−µ

< 23−µ

= Φ 23−µ

= 0.9591 ⇒ 23−µ

= 1.74 ⇒ µ = 14.25

5

5

5

5

2

• אם ) X1 , . . . , Xn ∼ N (µ, σ 2ב"ת ש"ה .אזי ) Sn ∼ N (nµ, nσ 2ו־ .Xn ∼ N µ, σn

• משפט הגבול המרכזי :כאשר nמספיק גדול ,זה נכון בקירוב לכל ) X1 , . . . , Xnמשתנים מקריים ב"ת ש"ה

כלשהם(.

דוגמא :ההסתברות שמערכת תקרוס ביום נתון היא ) 5%ב"ת בימים אחרים( .אם בשנה ישנם 300ימי עבודה,

מהי ההסתברות שהמערכת תקרוס בלא יותר מ־ 5ימים בשנה ,X ∼ Bin (300, 0.05) .מהו ) ?P (X ≤ 5נסמן

27

P

X = 300

i=1 Yi ∼ N

) .E [Yi ] = 0.05, V ar (Yi ) = 0.05 ∗ 0.95 = 0.0475 .Yi ∼ Ber (0.05כעת ) (15, 14.25

.P (X ≤ 5) = P Z ≤ √5−15

בקירוב לפי משפט הגבול המרכזי= Φ (−2.65) = 1 − Φ (2.65) = 0.004 .

14.75

P5 −15 15i

אם היינו משתמשים בקירוב פואסון ,X ∼ P ois (15) :אזי = 0.00279

.P (X ≤ 5) = i=0 eבמקרה

!i

כזה פואסון יהיה עדיף ,אבל נורמלי יותר נוח.

• אי שוויון צ'בישב:

σ2

ε2

≤ ) P (|X − µ| ≥ εלכל .ε > 0

דוגמא :בדקו רישום של שני מיליון לידות בניו יורק ,וגילו ש־ 1, 026, 000מתוכן היו לידות של זכרים .אם

מניחים כי ההסתברות לזכר ונקבה שוות ,עד כמה סבירה התוצאה הזו?

0.5

1

.P (X ≥ 1, 026, 000) = 12 P (|X − 1, 000, 000| ≥ 26, 000) ≤ 500,000כאשר ∼ X

= 26

= 1352

2

26,0002

).Bin (2 · 106 , 0.5

דוגמא X1 , . . . , Xn :מדגם מקרי מאוכלוסיה ,עם ) V ar (X) = σ 2 ,E [X] = µכאשר µנאמד בעזרת .(Xn

2

.P Xn − µ ≤ 1 ≥ 0.99מהו ה־ nהרצוי? 1 − P Xn − µ ≥ 1 ≥ 0.99 .V ar Xn = σnכלומר

) V ar(Xn

σ2

σ2

Xn − µ ≥ 1 ≤ 0.01

= 0.01ולכן נדרש

≥

כי

נדרש

כך

לשם

.P

n ≥ 0.01

1

n

בס"ד ,י"ט טבת תשע"א :תרגול 11

• אמידה :יש לנו X ∼ fθ־ כלומר מתפלג לפי פרמטר כלשהו ,אנו מעוניינים למצוא את הפרמטר .θיש לנו

X1 , . . . , Xnמדגם מקרי θˆ =g (X1 , . . ., Xn ) .הוא אומד או סטטיסטי ל־ .θיש לנו מדד

2

h i

2

ˆ .M SE θˆ = E θ − θבעצם M SEהוא פונקציה של .θ

= V ar θˆ + E θˆ − θ

• דוגמא ,E [X] = µ1 , V ar (X) = σ 2 :ומ"מ Yעם .E [Y ] = µ2 , V ar (Y ) = 2σ 2

σ .θ = µ1 + 2µ2ידוע .יש לנו .X, Yהציעו אומד חסר הטיה.

2

2

M SE θˆ = V ar θˆ = V ar X + 4V ar Y = σn + 4·σכאשר

.θˆ = X + 2Yמהו ה־ = σ 2 n1 + m8

m

n, mגודל המדגמים של .X, Y

אנו מחפשים את

בודד ,ודגימה של Yעולה 2ש"ח .מהי החלוקה

אם יש לנו תקציב של nשקלים ודגימה של X

עולה שקל

16

2 1

האופטימלית? נסמן ־ x־הדגימה ב־ .Xנמזער את ):σ x + (n−x

1

16

2

σ − 2+

= 0

x

(n − x)2

16x2 − (n − x)2 = 0

4x = n − x

n

= x

5

ניקח חמישית מהתקציב לדגום מ־ ,Xוכל השאר ל־ .Y

• שיטת המומנטים .X ∼ fθ1 ,...,θm :אם )] θ1 = g1 (E [X] , . . . , E [X mוכו' ,אזי

X, X 2 , . . . , X m

.θi = gi

– דוגמא :נתונה מערכת בה ) X1 ∼ exp (λ) , X2 ∼ exp (λב"ת אורכי החיים של המכשירים .כל

פעם שמתקלקל רכיב מחליפים את כל המערכת .נתונים לנו הזמנים בין nקריסות המערכת .נגדיר

1

1

λ = 2E[Yאז

,E [Y ] = 2λולכן

) .Y = min (X1 , X2כלומר ) .Y ∼ exp (2λאנו רוצים לאמוד את :λ

]

1

2

נאמוד ˆ = 1

√ =λ

.λנניח שמדדו רק את .Y 2נתבונן במשוואה E [Y ] = 4λ2 2 = 2λ1 2כלומר

2

2Y

] 2E[Y

ולכן נאמוד

ˆ = √1

.λ

2Y 2

28

בס"ד ,כ"ו טבת תשע"א :תרגול 12־ אמידה נקודתית

• אומד נראות מירבית :נניח .X ∼ fθיש לנו מדגם X1 , . . . , Xnמקרי.

Q

נסמן ) .L (θ; x1 , . . . , xn ) = ni=1 fX (xi ; θזוהי פונקציה של ,θואנו רוצים למקסם אותה.

Q

– דוגמא .X ∼ Geo (p) :אזי .L (p; x1 , . . . , xn ) = ni=1 p (1 − p)xi −1

P

P

L

1

= np − 1−p

נקבל כי ) .log L = n log p + log (1 − p) ni=1 (xi − 1לכן )( xi − n

0 = ∂ log

∂p

ˆ.

כלומר pM LE = X1

1 − eθ−x x > θ

– דוגמא:

= ) .X ∼ FX (x; θמצא אנ"מ ל־ θע"ס מדגם מקרי .X1 , . . . , Xn

0

o.w.

eθ−x x > θ

,

= ).fX (x; θ

0

o.w.

) , θ ≤ min (xi

xi

Pn

i=1

= enθ e−

xi

Pn

i=1

eθ−xi = enθ−

n

Y

= ) L (θ; x1 , . . . , xn

i=1

כדי למקסם= n ,

) .min (xi

∂ ln L

∂θ

= .0הנגזרת לעולם לא מתאפסת ,והפונקציה עולה ,ותיעצר רק ב־= θˆM LE

• רווח סמך :נניח X1 , . . . , Xn ,X ∼ fθמדגם מקריi .ברמת סמך של .θ ∈ [g1 (x1 , . . . , xn , α) , g2 (x1 , . . . , xn , α)] ,1−αh

למשל ) X ∼ N (µ, σ 2כאשר σידוע .אזי .µ ∈ X ± √σn z1− α2

– דוגמא.X ∼ N (µ, 22 ) ,

.1מהי תוחלת אורך רווח הסמך ברמת סמך .1 − αנסמן Lאורך רווח הסמך:

σ

σ

σ

E [L] = E X + √ z1− α2 − E X − √ z1− α2 = 2 √ z1− α2

n

n

n

מונוטוני יורד עם .nמונוטוני עולה עם .1 − α

.2עבור n = 9ו־ 1 − α = 0.95מהו .L = 2.61 ?L

.3נדרשים ש־ ,L = 1מהי רמת הסמך? נפתןר את המשוואה ,1 = 34 z1− α2 ⇒ α = 0.45כלומר רמת

סמך של .0.55

.4אם נדרשים ש־ 1 − αיישאר 0.95ו־ ,L = 1מהו ה־ nהמינימלי? ⇒ n ≥ 87

√4 1.96

n

= .1

• אמידת רווח סמך .θ = e−λ ,X ∼ exp (λ) :ע"ס תצפית בודדת Xרוצים לבנות ר"ס ברמת סמך של .1 − α

P (X ≤ k) = FX (k) = 1 − e−λk = 1 − θk = 1 − α .1כלומר .θk = αאו

√

log α

).1 − α = P x ≤ log θ = P log θ ≥ logx α = P (θ ≥ x α

1 − α ≥ P (X ≥ k) = 1 − FX (k) = e−λk = θk = 1 − α .2כלומר

√

).1 − α = P X > log(1−α

לכן = P θ < x 1 − α

log θ

p α p

α

x

x

,

1

−

מסקנה :ברמת סמך של ,1 − α

2

2

∈ .θ

29

)log(1−α

log θ

= .k

log α

log θ

= .kלכן

בס"ד ,ד' שבט תשע"א :תרגול 13

• נושאים שלא מופיעים בדוגמאות :מ"מ משותפים ,צפיפות משותפת ,והתניה .יש תרגיל של בדיקת השערות עם

פתרון.

• בדיקת השערות .H0 : X ∼ f0 , H1 : X ∼ f1 :יש טעות מסוג ראשון ,דחייה שגויה ,מסומנת ב־) αרמת

המובהקות( ,וטעות מסוג שני של קבלה שגויה ,מסומנת ב־ 1 − β)βהעוצמה של המבחן(.

לדוגמא ,X ∼ N (µ, σ 2 ) :וההשערות הן .H0 : µ = µ0 , H1 = µ 6= µ0או H1 : µ < µ0או .H1 : µ > µ0

איזורי הדחייה יהיו ,X − µ0 > √σn z1− α2או X < µ0 − √σn z1−αאו .X > µ0 + √σn z1−α

דוגמא :התוחלת ההיסטורית של הטמפרטורה היומית באוגוסט היא ◦ 30עם סטיית תקן של ◦) 2נניח נורמליות(.

הממוצע של המדידה הנוכחית היא .X = 30.7האם התוחלת עלתה בר"מ של ?1%, 5%יש לנו ) .X ∼ N (µ, 22

ההשערות הן .H0 : µ = 30, H1 : µ > 30המבחן שלנו יהיה ,X > 30 + z0.95 = 30.59וברמת מובהקות של

5%נדחה את .H0וברור שגם ברמה של .10%עבור 1%המבחן יהיה ,X > 30 + z0.99 = 32.326ולכן נקבל

את .H0

• ערך :Pההסתברות תחת הנחת H0לקבל מדגם קיצוני יותר .למשל במקרים שתיארנו לעיל:

| .PH0 X ≥ x , PH0 X ≤ x , PH0 X − µ0 > |x − µ0זו רמת המובהקות המינימלית בה נדחה את

√

.H0נחזור לדוגמא= 1 − Φ (1.95) = 0.026 :

.pv = PH0 X > 30.7 = P Z > 30.7−30מסקנה :רמת

2/ 31

נדחה את H0היא .2.6%אם הדיון הוא האם היה שינוי )ולא עליה( הערך היה

המובהקות המינימלית בה

√

0.7 31

.pv = PH0 X − 30 ≥ 0.7 = P |Z| ≥ 2

= 2 (1 − Φ (1.95)) = 0.051

• מבחן יחס הנראות :נועד לבדוק השערות פשוטות מהצורה .H0 : θ = θ0 , H1 : θ = θ1ניקח )X ∼ P ois (λ

) L (X ,...,X ;λ

עם ההשערות .H0 : λ = λ0 , H1 : λ = λ1נגדיר את יחס הנראות ) .λ (X1 , . . . , Xn ) = LHH1 (X11 ,...,Xnn ;λ10המבחן

0

P xi

Q −λ λi1

1

e

i

−n(λ1 −λ0 ) λ1

!i

הוא מהצורה .λ (X) > Cבמקרה שלנו נקבל > C

.λ (X) = Qמבחן יחס

i = e

λ0

−λ1 λ1

ie

!i

P

הנראות יהיה . ni=1 Xi ≥ C 0

30

© Copyright 2026